Как опытный аналитик с многолетним опытом наблюдения за быстрым развитием технологий, я все больше обеспокоен предстоящим появлением общего искусственного интеллекта (AGI). Недавние комментарии Эрика Шмидта и других видных деятелей в этой области только подчеркивают эти опасения.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"Помимо решения проблем безопасности и конфиденциальности, продолжаются споры о том, может ли продвинутый генеративный ИИ представлять угрозу существованию человечества, поскольку технологии продолжают развиваться быстрыми темпами. Примечательно, что Роман Ямпольский, известный исследователь безопасности ИИ и директор Лаборатории кибербезопасности в Университете Луисвилля (чье предсказание дает 99,99999% вероятность того, что ИИ в конечном итоге положит конец человечеству), предположил, что достижение общего искусственного интеллекта (AGI) невозможно. уже не привязаны к конкретному графику. Вместо этого он считает, что вопрос просто в том, кто сможет накопить достаточно финансовых ресурсов для приобретения достаточных вычислительных мощностей и центров обработки данных.

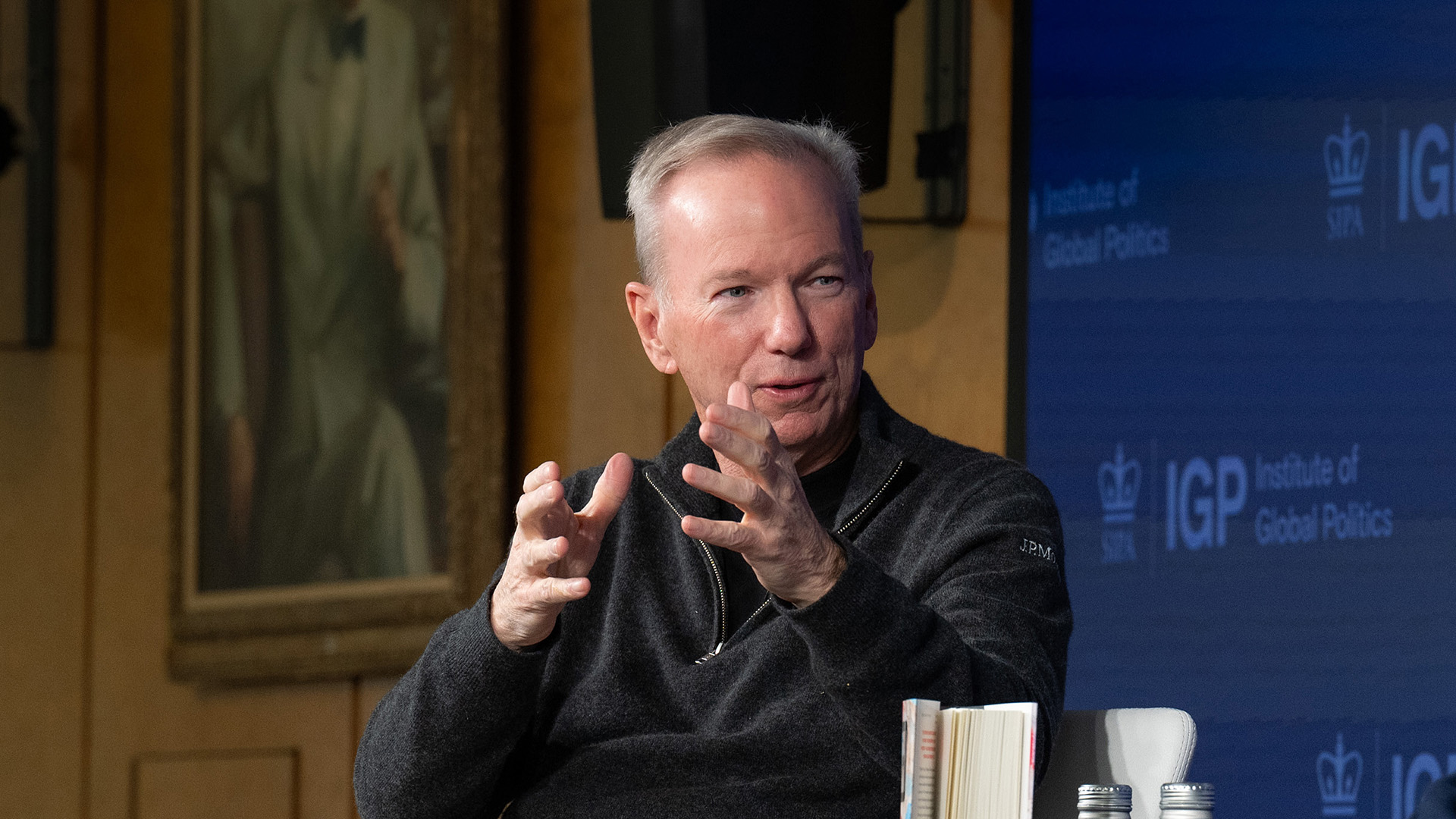

Стоит отметить, что Сэм Альтман, генеральный директор OpenAI, вместе с Дарио Амодеи из Anthropic прогнозируют, что общий искусственный интеллект (AGI) будет разработан в течение следующих трех лет. Эта технология предполагает использование систем искусственного интеллекта, превосходящих человеческие когнитивные способности в различных задачах. Хотя Альтман считает, что при использовании существующего оборудования это может произойти раньше, чем ожидалось, Эрик Шмидт, бывший генеральный директор Google, предполагает, что нам, возможно, придется пересмотреть вопрос о продолжении разработки ИИ, как только эти системы начнут совершенствоваться самостоятельно (как сообщает Fortune).

В недавнем разговоре на канале ABC News руководитель дал это понять.

Если система становится способной к самосовершенствованию, нам следует глубоко задуматься о ее закрытии. Эта задача, несомненно, будет чрезвычайно сложной, и поддержание равновесия потребует больших усилий.

Наблюдения Шмидта о быстром развитии ИИ особенно актуальны в решающий момент, поскольку многочисленные исследования показывают, что OpenAI, возможно, уже достигла уровня искусственного общего интеллекта (AGI) после публичного запуска своей модели рассуждения o1. Более того, генеральный директор OpenAI Сэм Альтман намекнул, что нам, возможно, осталось всего несколько тысяч дней до достижения сверхразума.

Безопасен ли общий искусственный интеллект (AGI)?

Тем не менее, предыдущий член команды OpenAI выражает обеспокоенность тем, что OpenAI может вскоре достичь столь востребованной вехи AGI, но управление потенциальной системой искусственного интеллекта, превосходящей человеческие когнитивные способности, может оказаться сложной задачей для создателей ChatGPT.

По словам Сэма Альтмана, опасения по поводу безопасности, возникшие в связи с достижением AGI, могут не материализоваться в тот момент, когда AGI будет достигнут. Вместо этого он предполагает, что появление AGI может произойти с минимальными социальными последствиями, но он ожидает длительной фазы развития, которая продлится до 2025 года и далее. За этот период агенты и системы ИИ превзойдут человеческие возможности в большинстве задач.

Смотрите также

- Лучшие смартфоны. Что купить в марте 2026.

- vivo iQOO Z10x ОБЗОР: яркий экран, удобный сенсор отпечатков, объёмный накопитель

- Новые смартфоны. Что купить в марте 2026.

- Что такое Bazzite и лучше ли она, чем Windows для PC-гейминга? Я установил этот набирающий популярность дистрибутив Linux, чтобы проверить это самостоятельно.

- Нефть и бриллианты лидируют: обзор воскресных торгов на «СПБ Бирже» (08.03.2026 16:32)

- Неважно, на что вы фотографируете!

- Infinix Note 60 Ultra ОБЗОР: скоростная зарядка, объёмный накопитель, отличная камера

- Российский рынок: Нефть, геополитика и лидерство «Сбербанка» (11.03.2026 13:32)

- Руководство по Stellaris — Полное прохождение на 100%

- Realme 9 ОБЗОР: чёткое изображение, лёгкий, высокая автономность

2024-12-23 13:39