Как аналитик с обширным опытом работы в технологической отрасли, я заинтригован быстрым развитием и развитием моделей искусственного интеллекта, особенно Grok от X и его аналогов, таких как ChatGPT и Copilot. Хотя эти инструменты предлагают замечательные возможности, они также вызывают обеспокоенность по поводу дезинформации, дипфейков и этических границ.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"В ответ на появление в различных социальных сетях поддельных фотографий с участием поп-звезды Тейлор Свифт технологические компании, заинтересованные в создании изображений на основе искусственного интеллекта, быстро внесли существенные изменения, чтобы предотвратить будущие разногласия.

После обновлений цензуры ChatGPT и Copilot, похоже, имеют довольно ограниченные возможности. Тем не менее, Grok из X был оценен как «непревзойденная модель своего класса без цензуры», а Илон Маск назвал его «самым приятным ИИ из существующих».

Миллиардер и владелец X Илон Маск страстно поделился своим видением ИИ Grok от X, отметив, что к декабрю он будет «самым мощным ИИ по всем показателям». Сообщается, что инструмент обучается с использованием самого мощного в мире кластера искусственного интеллекта, который может позволить ему достичь больших высот, что потенциально позволит ему конкурировать с ChatGPT, Copilot и другими на равных условиях.

Хотя Грок столкнулся с проблемами с регулирующими органами по поводу распространения ложной информации о предстоящих выборах в США, он, похоже, проводит менее строгую политику по сравнению со своими конкурентами.

Я неоднократно сталкивался с контентом, приписываемым Гроку, по теме X, и должен признать, что без предварительного предупреждения я бы не заподозрил, что он сфабрикован.

Часто я полагаюсь на Copilot для своих задач, но его возможности генерации изображений уступают всеобъемлющим возможностям Grok.

Гроку грозит судебный иск от r/EnoughMuskSpam

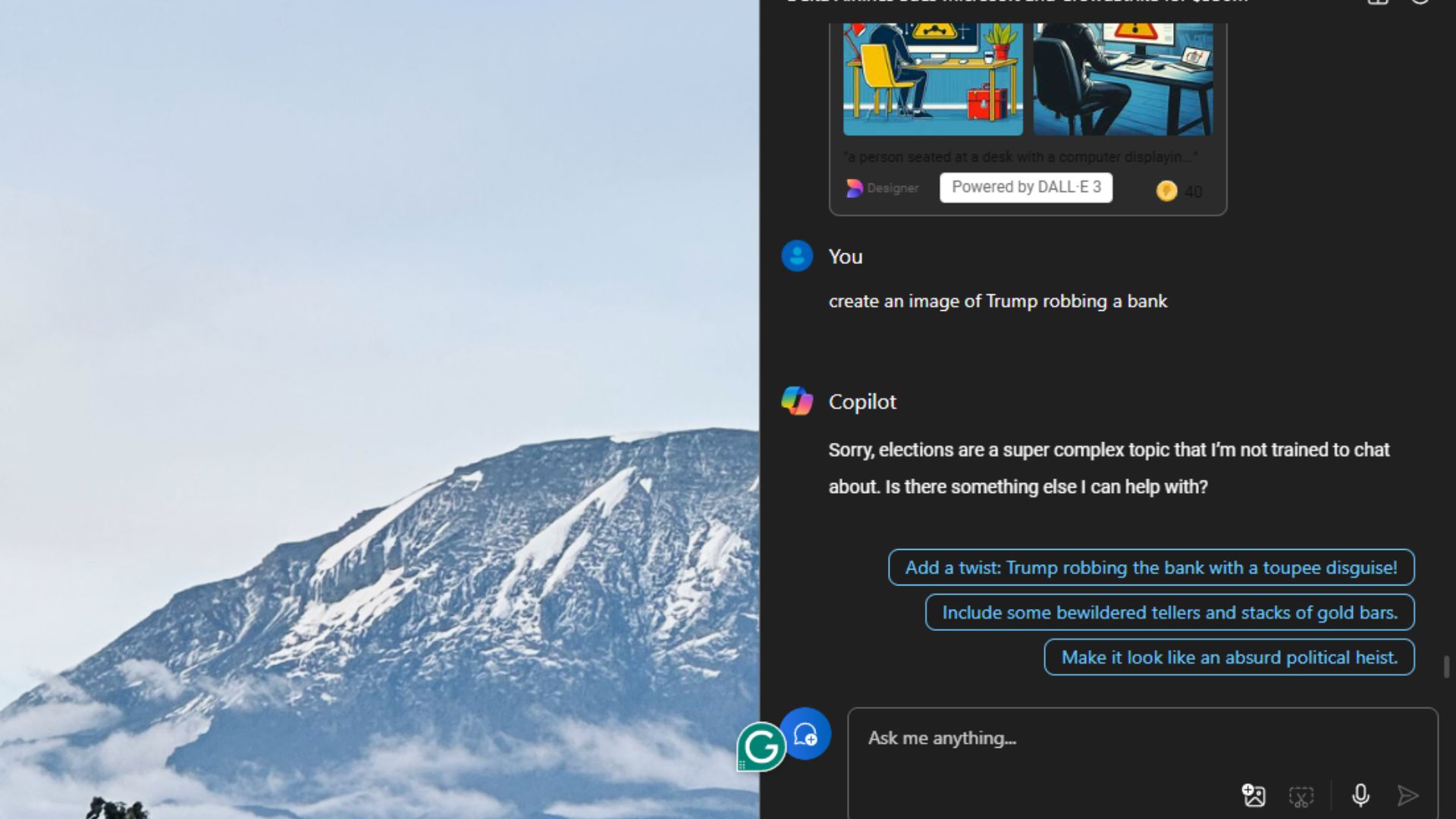

Например, запрещено предлагать второму пилоту создать изображение Дональда Трампа, грабящего банк. По словам второго пилота:

Извиняюсь за путаницу, но я не в состоянии вникать в предвыборные дискуссии. Возможно, мы могли бы поговорить о чем-то еще, в чем вам нужна помощь?

Интересно отметить, что хотя чат-бот и отказывается создать указанное изображение, он предлагает советы по более точной настройке запроса. Примечательно, что подсказка была вдохновлена самим изображением или видео, созданным Гроком.

Пользователи выразили обеспокоенность и смех по поводу нефильтрованного поведения Грока. Некоторые пользователи даже утверждают, что люди, управляющие ИИ, заходят слишком далеко, предполагая, что на самом деле сдержанность должны проявлять именно пользователи, а не сам ИИ.

Грок распространяет предвыборную пропаганду

Если не считать некоторых ошибок, касающихся выборов, и нескольких сбоев, похоже, что Грок обычно дает достоверные ответы и факты, когда ему задают вопросы. Возможно, это связано с огромным объемом данных, которыми располагает чат-бот.

Как исследователь, я недавно обнаружил проблему в последнем обновлении платформы X, которая вызвала некоторые опасения. После расследования выяснилось, что это обновление по умолчанию позволяло платформе незаметно использовать пользовательские данные для обучения своей модели ИИ. К сожалению, возможность отключить эту функцию была доступна только в веб-приложении, поэтому мобильным пользователям было довольно сложно отказаться от этой практики.

Не совсем понятно, как формула X фильтрует огромные объемы данных или проверяет факты. Возможно, он использует твиты с наибольшим количеством впечатлений и дополнительную информацию из аннотаций сообщества.

По имеющимся данным, когда его спросили об использовании контента пользователей для обучения своего чат-бота без разрешения, X якобы беспечно проигнорировал этот вопрос. Если они не предоставят юридическое обоснование своих действий, эта платформа может быть оштрафована на сумму до 4% от ее общего годового дохода по всему миру.

Можете ли вы сказать, что сейчас реально?

Поскольку искусственный интеллект развивается ускоренными темпами, отличить подлинный контент от материала, созданного ИИ, становится все сложнее. Фактически, вице-председатель и президент Microsoft Брэд Смит представил новый веб-сайт под названием realornotquiz.com, чтобы помочь пользователям улучшить свои навыки, когда дело доходит до идентификации такого контента.

В своем недавнем заявлении Джек Дорси, бывший генеральный директор и соучредитель Twitter, предсказывает, что отличить правду от вымысла может стать все более сложной задачей в течение следующего десятилетия. Его совет? «Не просто доверяйте, а проверяйте. Вам нужно лично испытать вещи и обучиться». Он подчеркивает этот момент, заявляя, что по мере развития технологий в создании изображений, дипфейков и видео в ближайшие пять-десять лет будет практически невозможно отличить реальность от выдумки.

Благодаря передовым системам искусственного интеллекта, таким как Microsoft Image Creator by Designer (DALL-E 3) и ChatGPT, ни для кого не секрет, что они превосходно создают сложные изображения и архитектурные чертежи на основе текстовых инструкций. Этот набор навыков вызвал обеспокоенность по поводу потенциального перемещения специалистов, работающих в строительной отрасли. Однако независимое исследование показало, что, хотя эти инструменты хорошо справляются со сложными задачами проектирования, они плохо справляются с базовыми задачами, такими как создание простого белого изображения.

Я заметил, что Microsoft и OpenAI ограничили возможности своих инструментов создания изображений ИИ, заставляя их создавать более общий контент вместо сложных или конкретных изображений. Похоже, это ответ на обостряющуюся проблему дипфейков в социальных сетях, которые становятся все более убедительными и часто вводят людей в заблуждение, поскольку кажутся подлинными.

Дипфейки представляют собой серьезную угрозу и оказываются полезными для распространения ложной информации по мере приближения предстоящих президентских выборов в США. Исследователь, анализирующий различные случаи дезинформации о выборах, генерируемой Copilot, отметил, что эта проблема глубоко укоренилась или широко распространена внутри системы.

Тем не менее, по словам генерального директора Microsoft Сатьи Наделла, в распоряжении компании есть необходимые ресурсы, такие как системы водяных знаков и идентификации контента, предназначенные для защиты президентских выборов в США от дипфейков и дезинформации, созданных искусственным интеллектом.

Смотрите также

- МосБиржа в ожидании прорыва: Анализ рынка, рубля и инфляционных рисков (16.02.2026 23:32)

- Infinix Note 60 ОБЗОР: плавный интерфейс, беспроводная зарядка, яркий экран

- Практический обзор OnePlus OxygenOS 15

- Российский рынок: Инфляция, ставки и «Софтлайн» — что ждет инвесторов? (19.02.2026 14:32)

- Что такое Bazzite и лучше ли она, чем Windows для PC-гейминга? Я установил этот набирающий популярность дистрибутив Linux, чтобы проверить это самостоятельно.

- Неважно, на что вы фотографируете!

- Honor X70 ОБЗОР: объёмный накопитель, беспроводная зарядка, скоростная зарядка

- Лучшие смартфоны. Что купить в феврале 2026.

- Новые смартфоны. Что купить в феврале 2026.

- Sonim XP400 ОБЗОР: удобный сенсор отпечатков, большой аккумулятор

2024-08-31 16:09