Одно из осознаний, которое пришло ко мне после того, как я стал родителем, заключается в том, что время действительно ценно, особенно количество онлайн-контента, которое я ежедневно потребляю для работы. Будь то исследования, отслеживание новостей или обзоров, или извлечение конкретных деталей, моя работа требует значительного объема чтения.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"Совместник превосходно справляется с созданием лаконичных резюме и продолжает значительно улучшаться. Раньше мне приходилось явно указывать свои требования и желаемый формат вывода. Теперь он справляется со всем плавно и эффективно.

Вместо этого, в последнее время я больше углубился в локальные решения с искусственным интеллектом, такие как Ollama и LM Studio, вместо того, чтобы полагаться исключительно на инструменты вроде Copilot, Me, ChatGPT и Google Gemini.

Похоже, что несколько способов воссоздать эту функцию связаны с использованием Python. Хотя я не против некоторого экспериментирования, мне интересно, существует ли простое решение на основе браузера, которое могло бы выполнить то, что мне нужно.

Позитивный момент в том, что я что-то обнаружил, но, к сожалению, пока это не так эффективно, как Copilot, в выполнении этой конкретной задачи.

Ollama в фоновом режиме и Page Assist на переднем плане

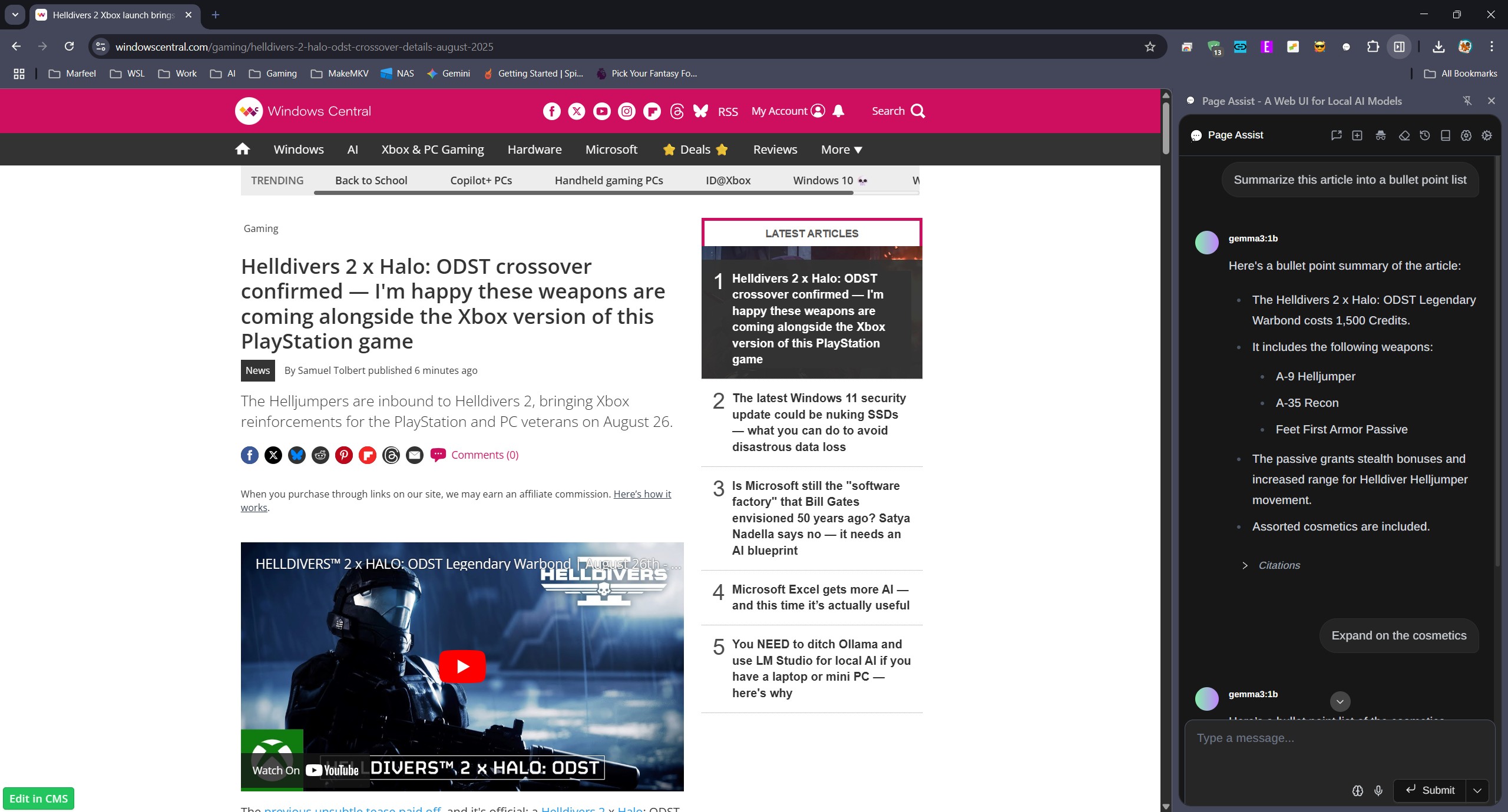

В процессе поиска возможных решений я наткнулся на Page Assist – доступный в Chrome Web Store (или в расширениях Microsoft Edge, если вы предпочитаете). Этот инструмент – не просто расширение, а скорее, полноценное веб-приложение, служащее графическим пользовательским интерфейсом для Ollama.

Этот инструмент невероятно универсален и обладает множеством функций. Пока что я не могу придумать, чего в нем не хватает. Он значительно упрощает работу с локальными языковыми моделями и превосходит приложение Ollama по уровню сложности.

Я сосредотачиваюсь не на всей структуре, а скорее на функции боковой панели, которая позволяет взаимодействовать с уже открытой веб-страницей. И угадайте что? Я нашёл её!

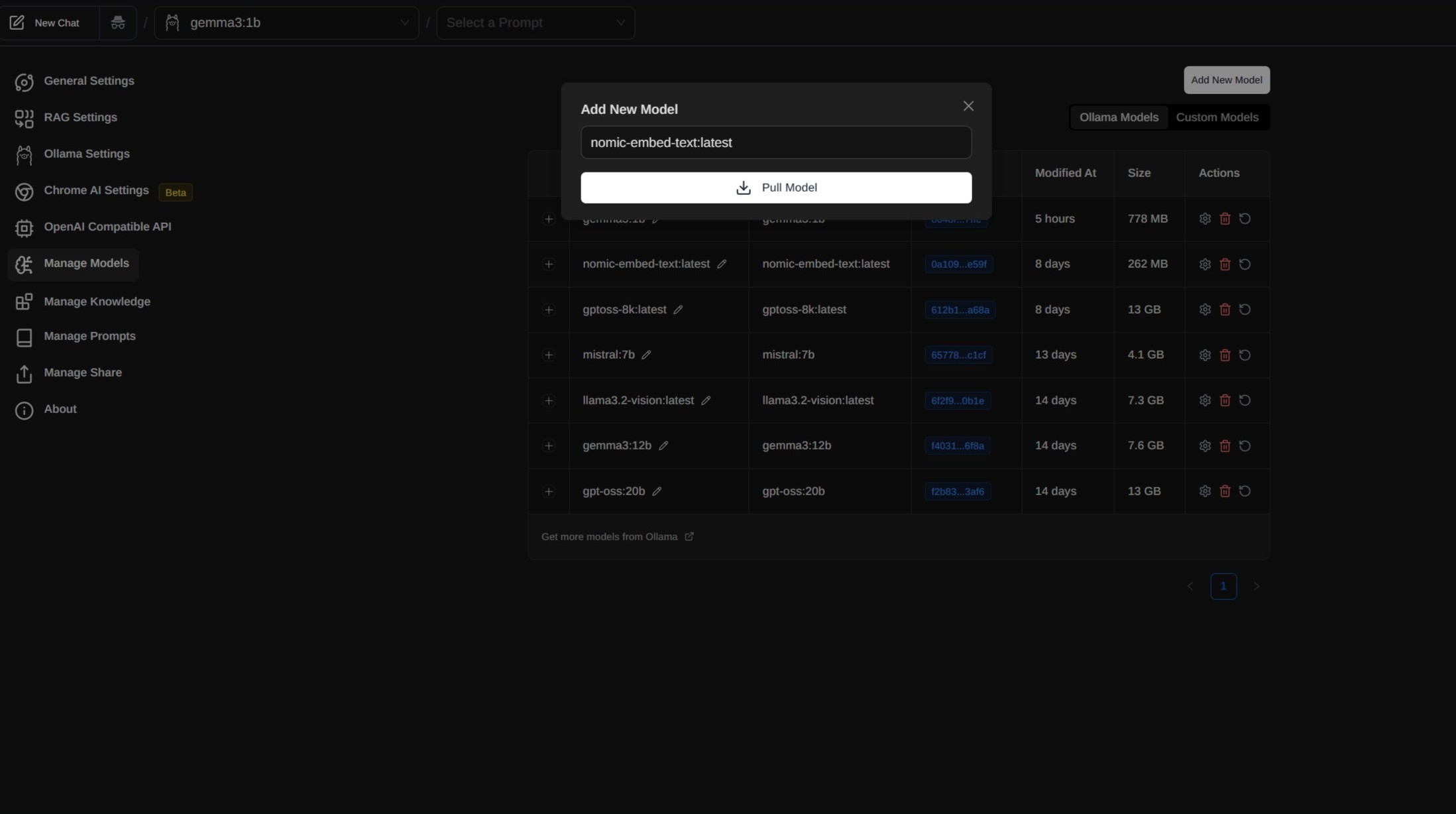

Для взаимодействия со веб-страницей с помощью Page Assist вашей настройке Ollama потребуется дополнительный шаг. В частности, вам потребуется реализовать некоторые регулярные выражения (Regex) для облегчения взаимодействия.

Возможная перефразировка термина ‘Генерация с поиском’ может быть ‘Улучшенная генерация текста с извлечением данных’. Этот термин относится к методу, используемому в искусственном интеллекте, когда система ИИ расширяет свои возможности генерации, извлекая соответствующую информацию из внешних источников данных, таких как базы данных или другие документы, в процессе создания ответов или генерации текста. Интегрируя поиск данных в процесс генерации, ИИ может создавать более точные, информативные и контекстуально уместные ответы по сравнению с системой, полагающейся исключительно на свою собственную внутреннюю базу знаний.

Для взаимодействия с веб-страницей через Page Assist требуется включить модель внедрения в Ollama. Приложение упрощает этот процесс, предлагая Nomic Embed. Следовательно, я поступил так же, получив доступ к Page Assist через опцию «Управление моделями» в настройках, добавил новую модель и ввёл «nomic-embed-text:latest» в соответствующее поле.

Другой способ сказать это: чтобы продолжить, вам нужно только выяснить, как открыть боковую панель. Обычно она доступна из контекстного меню правой кнопкой мыши. Поэтому, когда вы находитесь на странице, которую хотите обсудить, щелкните правой кнопкой мыши и откройте боковую панель, чтобы начать чат.

Это хорошо, но не так хорошо, как Copilot.

Это действительно работает? Да, работает. Но, к сожалению, работает не так хорошо, как Copilot.

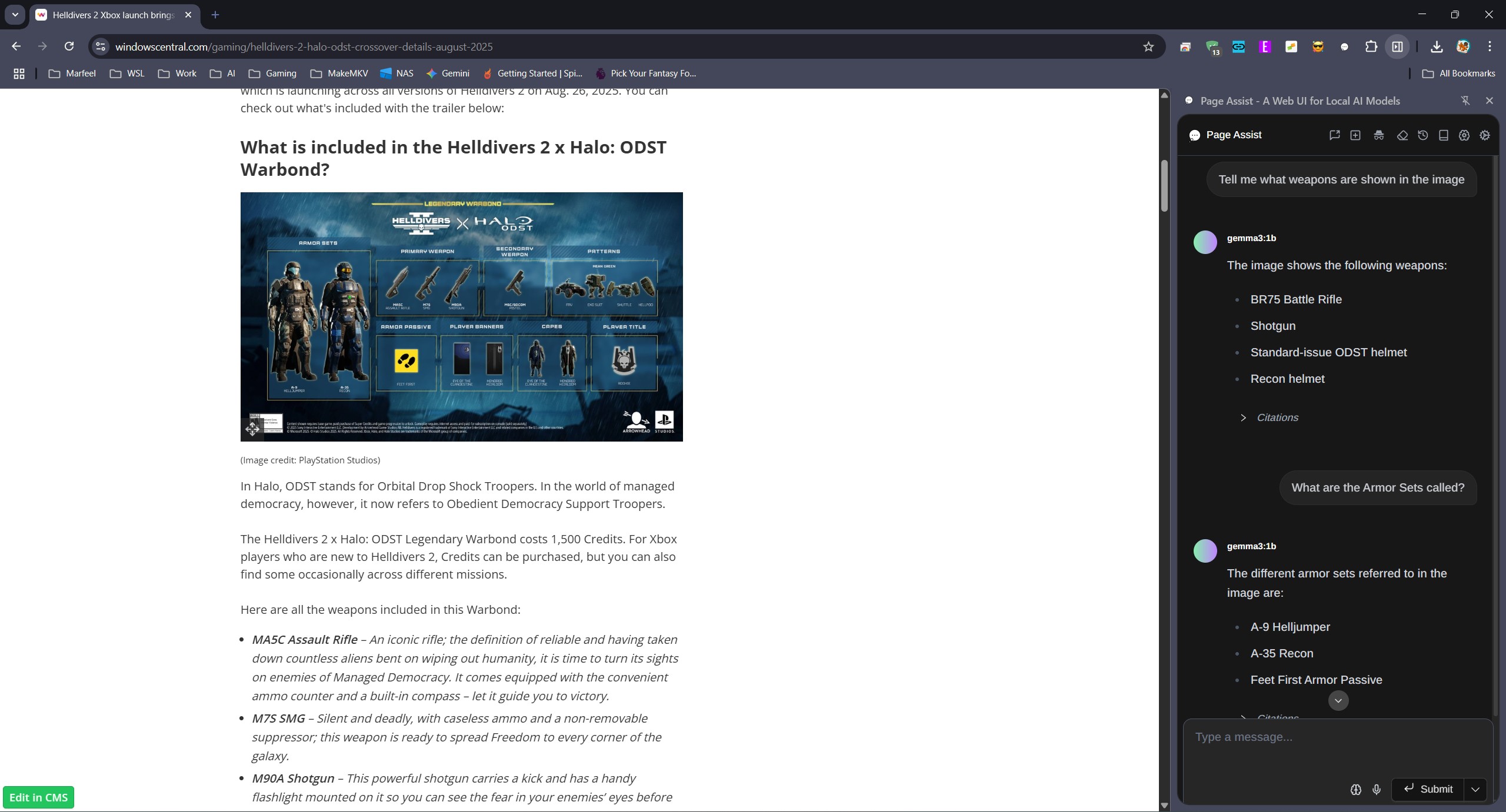

В первую очередь, позвольте выделить положительные стороны. Используя различные модели, я могу эффективно сжимать статьи. Более крупные модели, как правило, работают лучше. Хотя неразумно ожидать, что gemma3:1b будет соответствовать возможностям gpt-oss:20b, она выполняет свою задачу по суммированию веб-контента, как и было предписано.

Как преданный пользователь, я рад сообщить, что этот инструмент разработан для использования зрения на изображениях при оснащении соответствующей моделью. Однако я признаю, что изначально мог выбрать более мелкую модель, которая, возможно, не является оптимальной, как вы можете видеть на изображении выше. Тем не менее, будьте уверены, что он полностью способен обрабатывать и интерпретировать изображения, используя оптическое распознавание символов (OCR) и многое другое!

На данный момент всё выглядит хорошо. Однако, основная проблема заключается в том, что он не распознает переходы между разными веб-страницами. В моей работе, когда я использую режим скорочтения, я держу боковую панель открытой и повторно выдаю команду при переходе по различным страницам.

Если я не начинаю новый диалог или явно не прошу модель игнорировать предыдущую статью, она часто повторяет информацию из старой статьи при обобщении новой. Это не критичная проблема, но может быть несколько раздражающим.

Среди всех протестированных мной моделей ни одна не дала результатов, сравнимых с высококачественными резюме, генерируемыми Copilot. Что отличает Copilot, так это его способность предоставлять превосходные резюме, даже без очень подробного первоначального запроса.

При наличии некоторого времени я считаю, что мог бы улучшить это, но для этого требуются мои усилия. Здесь акцент делается на эффективности и простоте использования. В то время как Copilot больше похож на общение в чате, эти локальные модели кажутся прямыми и фактическими.

Как аналитик, я считаю Copilot особенно полезным благодаря его способности задавать уточняющие вопросы. Хотя они не всегда нужны, бывают случаи, когда эти вопросы служат толчком, представляя мне точки зрения или подходы, которые я ранее не рассматривал.

Случай, когда я думаю, что, возможно, останусь с онлайн-искусственным интеллектом.

В определенных ситуациях использование локального искусственного интеллекта может предложить несколько преимуществ по сравнению с его онлайн-аналогами. Тем не менее, в данном конкретном случае мне необходимо подключение к интернету для доступа к веб-страницам, которые я хочу получить в сжатом виде. Учитывая, что локальный ИИ эффективно работает для меня, нет убедительных причин для переключения.

Я хотел бы напомнить всем, чтобы они изучили местную сферу искусственного интеллекта, поскольку в настоящее время это является для меня важным направлением, особенно в плане образования. Каждый день приносит мне новый опыт обучения.

Кроме того, в связи с темами, затронутыми в этой статье, я обнаружил еще один предпочтительный способ использования Ollama — Page Assist. Я считаю это исключительно впечатляющим, и, возможно, я углублюсь в его возможности в будущих публикациях, когда у меня будет возможность изучить его подробнее.

Но когда я работаю, думаю, я буду придерживаться онлайн-инструментов для этой задачи. По крайней мере, пока.

Смотрите также

- Фотографируем муравьёв с Андреем Павловым

- Обзор объектива Tokina 11-16mm f/2.8 AF

- Что купить фотографу. Рекомендации

- Honor 600 Pro ОБЗОР: чёткое изображение, отличная камера, плавный интерфейс

- Honor 600 ОБЗОР: лёгкий, плавный интерфейс, скоростная зарядка

- Realme 16T ОБЗОР: яркий экран, плавный интерфейс, большой аккумулятор

- Как правильно обрабатывать портрет в фотошоп

- Обзор Nikon D5500 DX

- Nikon D7200

- Неважно, на что вы фотографируете!

2025-08-21 14:41