Автор: Денис Аветисян

Исследователи представили систему, позволяющую виртуальным агентам активно использовать визуальные инструменты для более эффективного выполнения задач в графических средах.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

В статье описывается фреймворк GUI-Eyes, основанный на обучении с подкреплением и позволяющий агентам использовать инструменты для улучшения визуального восприятия и повышения эффективности выполнения задач в графическом интерфейсе.

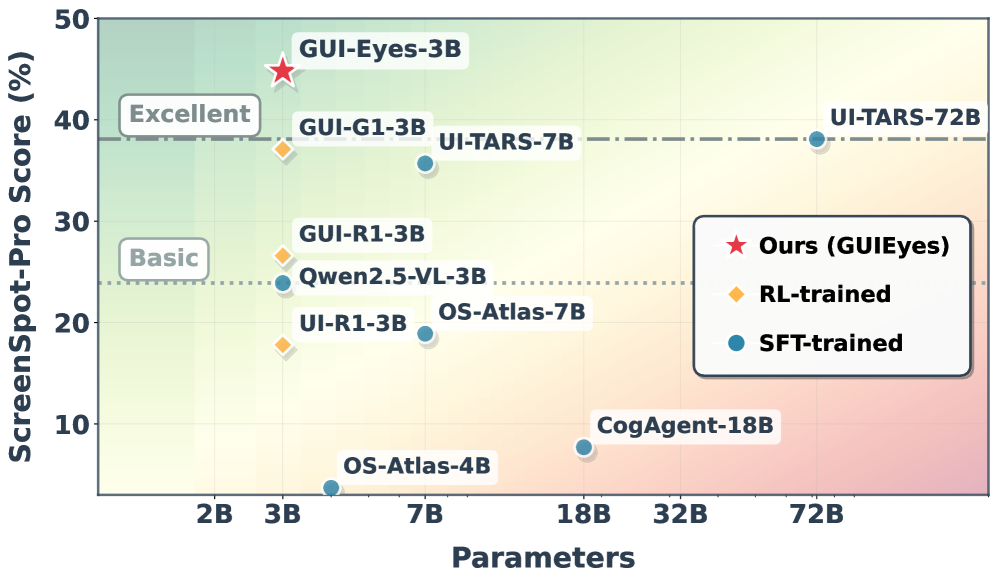

Несмотря на прогресс в области визуально-языковых моделей и обучения с подкреплением, автоматизация графических интерфейсов часто страдает от пассивного восприятия и неспособности адаптироваться к изменяющимся условиям. В данной работе, представленной под названием ‘GUI-Eyes: Tool-Augmented Perception for Visual Grounding in GUI Agents’, предлагается новый подход, основанный на обучении с подкреплением для активного визуального восприятия, позволяющий агентам стратегически использовать инструменты для получения более информативных наблюдений. Ключевым результатом является повышение точности определения элементов интерфейса до 44.8% с использованием всего 3 тысяч размеченных образцов, что значительно превосходит существующие методы. Не откроет ли это путь к созданию более надежных и эффективных агентов для автоматизации задач в графических интерфейсах, способных к адаптивному и целенаправленному восприятию?

Распознавание Границы: Вызов Автоматизации GUI

Традиционные методы автоматизации графических интерфейсов пользователя (GUI) часто опираются на хрупкие селекторы, такие как имена элементов или их координаты на экране. Эта зависимость создает серьезные проблемы при работе с динамически изменяющимися интерфейсами, где расположение и свойства элементов могут меняться даже при незначительных обновлениях программного обеспечения. В результате, скрипты автоматизации, разработанные для статического интерфейса, быстро становятся неработоспособными, требуя постоянной поддержки и адаптации. Неспособность корректно распознавать и взаимодействовать с элементами, меняющимися во времени, значительно ограничивает надежность и масштабируемость систем автоматизации, что делает поиск более устойчивых подходов крайне актуальной задачей.

Несмотря на многообещающий потенциал, подходы к автоматизации графического интерфейса пользователя, основанные на компьютерном зрении, часто сталкиваются с ограничениями в эффективности рассуждений и адаптивности. В отличие от традиционных методов, опирающихся на жесткие селекторы, визуальные системы требуют способности к обобщению и пониманию контекста, что представляет собой сложную задачу. При динамических изменениях интерфейса, таких как перемещение элементов или изменение их внешнего вида, модели компьютерного зрения могут быстро терять точность, поскольку их обучение часто ограничивается конкретными визуальными паттернами. Поэтому, для достижения надежной автоматизации, необходимо разрабатывать более продвинутые алгоритмы, способные к абстрагированию, логическому выводу и адаптации к изменяющимся условиям, а не просто к распознаванию изображений.

Современные методы автоматизации графических интерфейсов сталкиваются с серьезными трудностями при выполнении сложных задач, требующих одновременного использования визуального восприятия и последовательного принятия решений. Существующие системы часто демонстрируют ограниченные возможности в ситуациях, где необходимо не просто идентифицировать элементы интерфейса, но и анализировать их взаимосвязи, прогнозировать последствия действий и адаптироваться к изменяющимся условиям. Например, выполнение комплексной операции, такой как заполнение многостраничной формы с динамически изменяющимися полями, требует не только распознавания визуальных элементов, но и понимания логики взаимодействия, способности обрабатывать ошибки и корректировать последовательность действий. Такая комбинация визуального анализа и логического мышления остается сложной задачей для большинства современных систем автоматизации, что ограничивает их применимость в реальных сценариях использования.

GUI-Eyes: Активное Восприятие и Обучение с Подкреплением

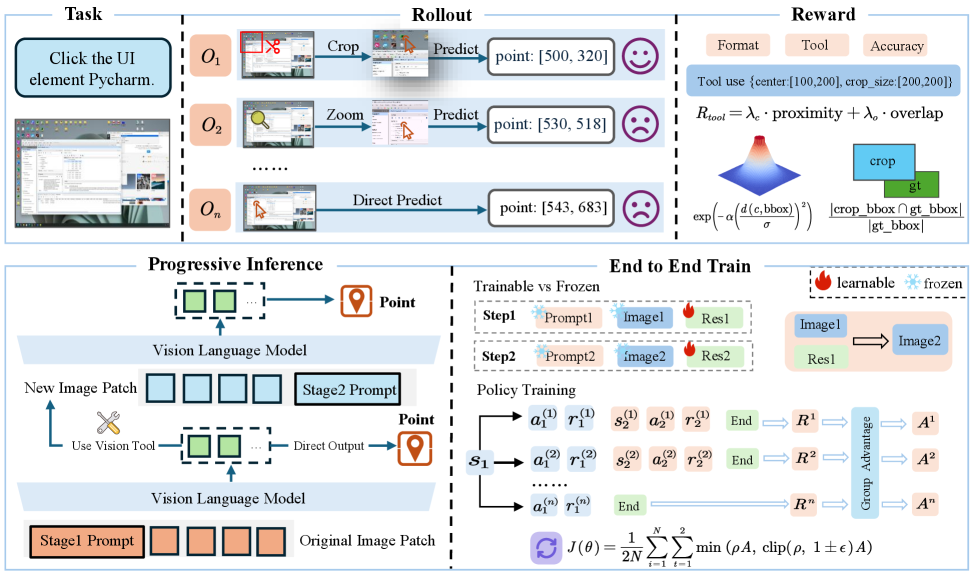

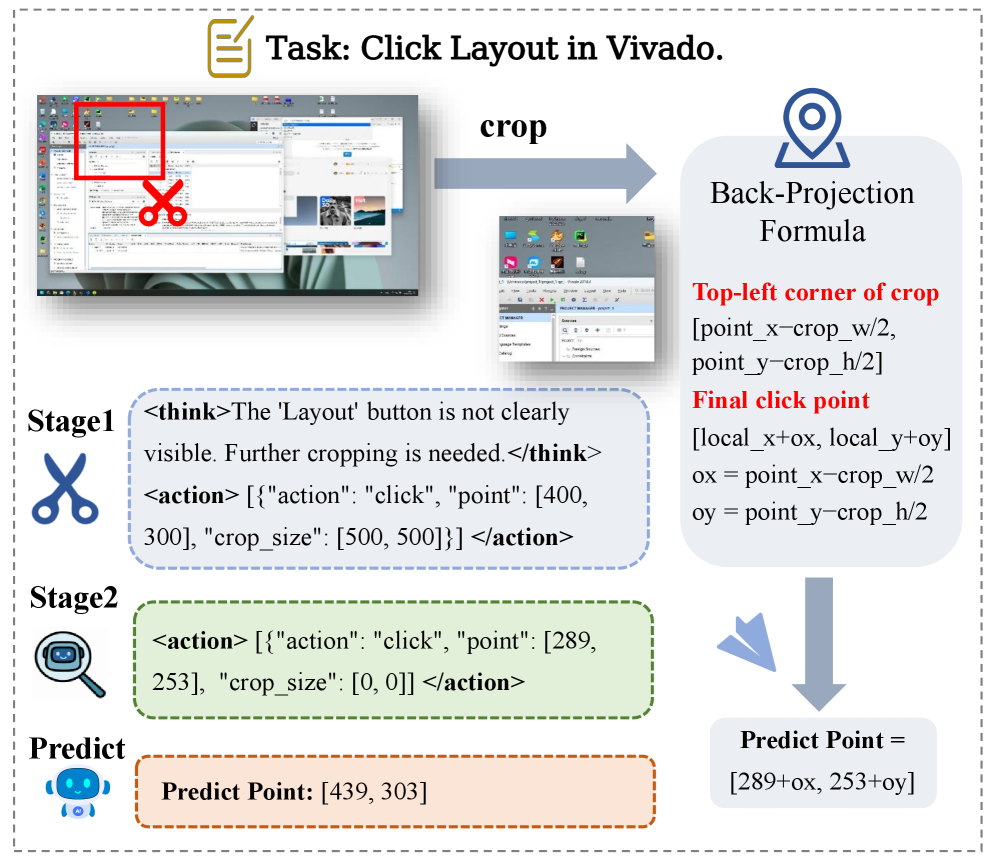

GUI-Eyes представляет собой фреймворк обучения с подкреплением, предназначенный для оснащения агентов, взаимодействующих с графическими пользовательскими интерфейсами (GUI), способностью к активному восприятию. В отличие от традиционных подходов, где агенты пассивно получают визуальную информацию, GUI-Eyes позволяет агенту динамически управлять фокусом зрения, целенаправленно собирая релевантные данные. Это достигается за счет интеграции механизмов активного поиска и отбора визуальной информации в процесс обучения, что позволяет агенту эффективно взаимодействовать с GUI и достигать поставленных целей, минимизируя объем обрабатываемой информации и повышая скорость обучения.

В рамках GUI-Eyes агент активно управляет фокусом визуального внимания, что позволяет ему целенаправленно собирать релевантную информацию. Вместо пассивного сканирования всего графического интерфейса, система динамически выбирает области, наиболее важные для текущей задачи. Это приводит к значительному снижению объема обрабатываемых данных и, как следствие, к повышению эффективности работы агента за счет минимизации избыточной обработки и ускорения принятия решений. Приоритезация визуального внимания позволяет агенту сосредоточиться на ключевых элементах интерфейса, игнорируя несущественные детали.

В отличие от традиционных систем, полагающихся на пассивное получение визуальной информации, GUI-Eyes использует возможности моделей «Зрение-Язык» для реализации активного исследования окружения. Этот подход позволяет агенту динамически выбирать, на какие элементы графического интерфейса обращать внимание, а какие игнорировать. Активное восприятие позволяет агенту целенаправленно собирать релевантные данные, необходимые для выполнения задачи, вместо обработки всего визуального потока. Это значительно повышает эффективность обучения с подкреплением и снижает вычислительные затраты, поскольку агент фокусируется на действительно важных областях экрана.

Оптимизация Поведения Агента: Функция Вознаграждения

Система GUI-Eyes использует многофакторную функцию вознаграждения, объединяющую три ключевых параметра: корректность формата, точность локализации и площадь покрытия. Оценка действий агента формируется на основе комбинации этих параметров, что позволяет учитывать различные аспекты успешного выполнения задачи. Корректность формата оценивает соответствие выходных данных ожидаемому структурированному виду. Точность локализации измеряет, насколько правильно агент определяет и взаимодействует с элементами интерфейса. Площадь покрытия учитывает, насколько полно агент исследует и взаимодействует со всеми релевантными областями графического интерфейса, максимизируя эффективность взаимодействия.

Для повышения точности действий агента в GUI-Eyes используется детализированная система вознаграждений, включающая в себя такие компоненты, как «Награда за пространственную близость» и «Награда за перекрытие области». «Награда за пространственную близость» оценивает, насколько близко действия агента соответствуют целевым элементам интерфейса, стимулируя точность позиционирования. «Награда за перекрытие области» измеряет степень перекрытия действий агента с целевой областью, что позволяет улучшить выделение и взаимодействие с нужными элементами. Комбинация этих компонентов обеспечивает гранулярную обратную связь, позволяя агенту постепенно уточнять свои действия и повышать эффективность выполнения задач.

Агент обучается с использованием алгоритма GRPO (Generalized Reinforcement Policy Optimization), представляющего собой метод оптимизации политики, направленный на повышение эффективности действий в сложных средах. В качестве основы для надежного восприятия окружающей среды используется большая мультимодальная модель Qwen2.5-VL, обеспечивающая обработку визуальной информации и ее интеграцию с другими данными. GRPO позволяет агенту адаптировать свою стратегию на основе получаемого вознаграждения, а Qwen2.5-VL — обеспечивать точное распознавание объектов и их характеристик, что критически важно для выполнения задач в GUI-Eyes.

Валидация и Бенчмаркинг GUI-Eyes: Подтверждение Превосходства

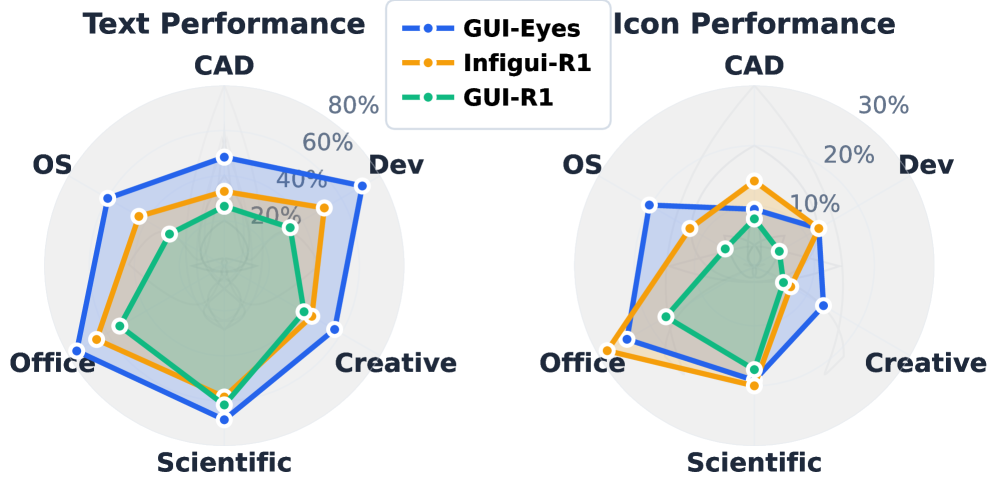

Для всесторонней оценки эффективности разработанной системы GUI-Eyes, проводилось тестирование на специализированных наборах данных ScreenSpot и ScreenSpot-Pro. Эти наборы данных признаны сложными для задач определения местоположения элементов графического интерфейса (GUI grounding) из-за высокой вариативности макетов и сложности визуального восприятия. ScreenSpot и ScreenSpot-Pro содержат изображения различных пользовательских интерфейсов, что позволяет проверить способность системы к обобщению и адаптации к новым, ранее не встречавшимся элементам управления. Использование этих наборов данных позволило объективно оценить производительность GUI-Eyes в условиях, максимально приближенных к реальным сценариям автоматизации пользовательского интерфейса.

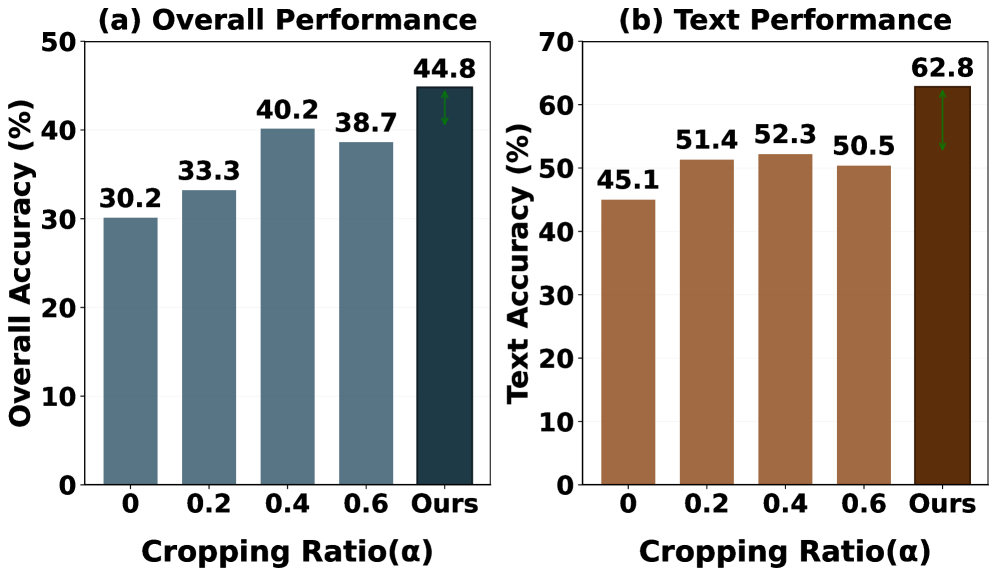

Исследования показали, что модель GUI-Eyes-3B достигла точности в 44.8% на бенчмарке ScreenSpot-Pro, что демонстрирует передовые результаты в области автоматизации графического интерфейса при ограниченном объеме обучающих данных. Этот показатель подчеркивает способность модели эффективно обобщать знания и адаптироваться к новым, ранее не встречавшимся элементам интерфейса, даже при недостатке размеченных примеров. Достижение такой высокой точности на сложном бенчмарке, как ScreenSpot-Pro, свидетельствует о значительном прогрессе в разработке систем, способных понимать и взаимодействовать с графическими интерфейсами приложений, открывая новые возможности для автоматизации задач и повышения продуктивности.

Исследование продемонстрировало выдающиеся результаты работы системы GUI-Eyes на эталонных наборах данных ScreenSpot и ScreenSpot-v2. Достигнута рекордная точность в 87.8% на оригинальном ScreenSpot и 88.4% на ScreenSpot-v2, что подтверждает превосходство данной модели в задачах автоматизации графического интерфейса. Эти показатели свидетельствуют о значительном прогрессе в области понимания и взаимодействия с элементами пользовательского интерфейса, открывая новые возможности для разработки более интеллектуальных и эффективных систем автоматизации.

Исследование, представленное в данной работе, демонстрирует стремление к глубокому пониманию систем взаимодействия с графическим интерфейсом. Разработка GUI-Eyes, позволяющая агентам активно воспринимать окружение посредством визуальных инструментов, подчеркивает важность не пассивного наблюдения, а целенаправленного анализа. Как однажды заметил Клод Шеннон: «Информация — это то, что уменьшает неопределенность». Этот принцип находит отражение в подходе, предложенном авторами, где активное восприятие с помощью инструментов снижает неопределенность агента при выполнении задач, позволяя ему более эффективно ориентироваться в сложном визуальном пространстве GUI и достигать поставленных целей. Фокусировка на активном восприятии и использовании инструментов для улучшения производительности GUI-агентов — это попытка взломать систему, понять ее изнутри, и, следовательно, контролировать ее.

Что Дальше?

Представленная работа, по сути, лишь приоткрывает завесу над тем, насколько примитивны текущие подходы к взаимодействию агентов с графическим интерфейсом. GUI-Eyes демонстрирует, что активное восприятие, вооруженное инструментами, — это не просто оптимизация, а фундаментальный сдвиг парадигмы. Однако, не стоит обольщаться — это лишь первая строка кода в огромном, неизученном репозитории реальности. Вопрос не в том, чтобы научить агента «видеть» скриншот, а в том, чтобы он понял логику, стоящую за каждым пикселем, каждую иконку — словно декомпилировал программу, написанную неизвестным программистом.

Очевидные ограничения касаются обобщения. Работает ли эта система, если интерфейс изменится, если появится новая кнопка, если шрифт станет другим? Это все равно, что пытаться запустить скомпилированный код на другой архитектуре. Более того, текущий подход требует явного определения инструментов. Следующий этап — создание агентов, способных самостоятельно изобретать инструменты, адаптировать их к конкретным задачам, словно инженеры-самоучки, работающие с ограниченным набором ресурсов.

В конечном счете, эта область исследований напоминает попытку прочесть исходный код вселенной. Мы видим лишь фрагменты, интерпретируем их, пытаемся построить модель, но всегда остаемся в неведении относительно истинной структуры. Задача не в том, чтобы создать «идеального агента», а в том, чтобы расширить границы нашего понимания того, что вообще возможно.

Оригинал статьи: https://arxiv.org/pdf/2601.09770.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- vivo iQOO Z10 Turbo+ ОБЗОР: скоростная зарядка, плавный интерфейс, объёмный накопитель

- Калькулятор глубины резкости. Как рассчитать ГРИП.

- Acer Aspire 5 Spin 14 ОБЗОР

- Обзор Asus VivoBook 16: лучше большинства бюджетных ноутбуков.

- AMD разворачивает «штаб-квартиру» для мониторинга нашего веб-сайта на предмет утечек.

- Рынок в смятении: Снижение ставки ЦБ, волатильность рубля и новые возможности для инвесторов (25.04.2026 01:32)

- Motorola Moto G77 ОБЗОР: отличная камера, лёгкий, чёткое изображение

- Как отслеживать активность диска в Windows 11

- Huawei Pura 90 Pro ОБЗОР: много памяти, беспроводная зарядка, чёткое изображение

- Мозг без обучения: Новая модель расшифровывает мысли между людьми

2026-01-16 08:13