Автор: Денис Аветисян

Новое исследование проливает свет на то, как большие языковые модели «понимают» и выражают эмоции, открывая возможности для более точной настройки и контроля.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

Аффективные способности больших моделей локализованы в слое feed-forward gating projection, что позволяет эффективно адаптировать их эмоциональный отклик.

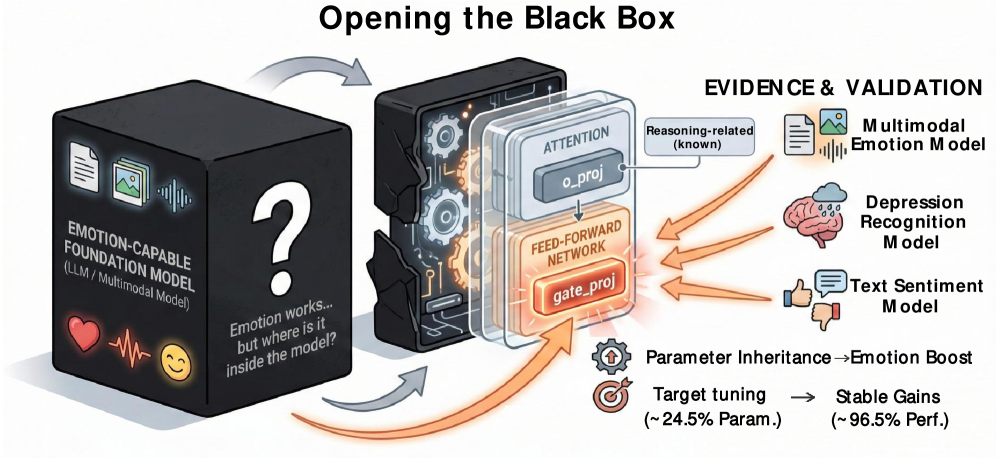

Несмотря на впечатляющие успехи современных мультимодальных моделей в распознавании и генерации эмоций, механизмы, лежащие в основе этих способностей, остаются малоизученными. В работе ‘Opening the Black Box: Preliminary Insights into Affective Modeling in Multimodal Foundation Models’ проведено систематическое исследование архитектурных особенностей, определяющих эмоциональный интеллект больших моделей. Полученные результаты указывают на то, что адаптация к задачам, связанным с эмоциями, преимущественно локализуется в слое gate\_proj прямой связи, а не в механизмах внимания. Открывает ли это путь к созданию более эффективных и контролируемых систем, способных к тонкому эмоциональному взаимодействию?

Раскрытие Эмоционального Интеллекта в Больших Языковых Моделях

Современные большие языковые модели, демонстрирующие поразительные способности в обработке и генерации текста, зачастую оказываются неспособны к тонкому пониманию эмоциональной составляющей коммуникации. Несмотря на умение имитировать различные стили и тональности, модели нередко выдают ответы, лишенные истинной эмоциональной глубины и чувствительности к контексту. Это проявляется в неспособности распознавать сложные эмоциональные нюансы, а также в генерации текстов, которые кажутся формальными или даже неуместными в ситуациях, требующих эмпатии и эмоционального интеллекта. Данное ограничение подчеркивает разрыв между лингвистической компетенцией и подлинным пониманием человеческих чувств, что является существенным препятствием для создания по-настоящему интеллектуальных и полезных систем искусственного интеллекта.

Традиционные методы контролируемого обучения, при которых все параметры языковой модели подвергаются настройке, оказываются чрезвычайно затратными в вычислительном плане. Это не только требует значительных ресурсов, но и не позволяет точно определить, какие именно аспекты модели нуждаются в адаптации для более точного понимания и воспроизведения эмоций. Исследования показывают, что большая часть параметров может оставаться неизменной, в то время как фокусировка на ключевых областях, отвечающих за обработку аффективной информации, может значительно повысить эффективность обучения и снизить требуемые вычислительные мощности. Такой подход позволяет более целенаправленно улучшать способность модели распознавать, интерпретировать и генерировать текст, отражающий эмоциональный контекст.

Структурная Специализация: Где Обитают Аффективные Сигналы

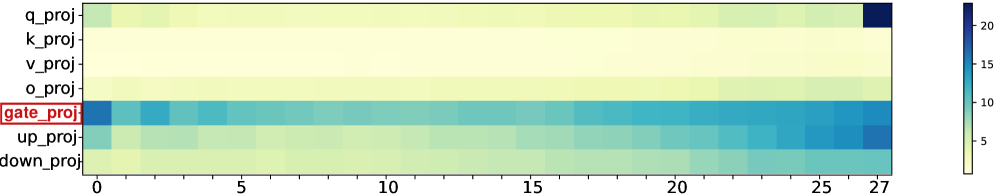

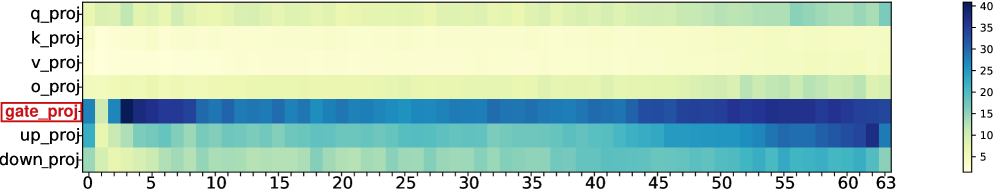

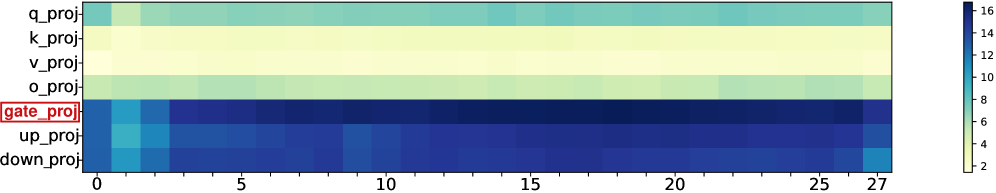

Наше исследование выявило структурную специализацию в больших языковых моделях (LLM). Анализ показал, что проекция выхода механизма внимания (Attention Output Projection) играет ключевую роль в процессах рассуждения и логического вывода. В то же время, управление аффективными способностями модели, то есть способностью моделировать и обрабатывать эмоциональную окраску информации, осуществляется проекцией вентиля (Gating Projection) внутри полносвязного слоя (Feed-Forward Network). Таким образом, функции рассуждения и аффективной обработки не распределены равномерно по всей сети, а локализованы в отдельных её компонентах.

Исследования показали, что моделирование аффектов и логическое мышление не распределены равномерно по всей структуре больших языковых моделей (LLM). Вместо этого, эти функции локализованы в различных компонентах сети. В частности, обработка аффективных сигналов преимущественно осуществляется в области Gating Projection внутри Feed-Forward Network, в то время как Attention Output Projection играет ключевую роль в процессах рассуждения. Данная структурная специализация указывает на то, что отдельные модули LLM отвечают за обработку различных типов информации, что позволяет более эффективно адаптировать модель к конкретным задачам и оптимизировать использование вычислительных ресурсов.

Структурное разделение между компонентами, отвечающими за рассуждения и эмоциональное моделирование в больших языковых моделях (LLM), создает основу для эффективных стратегий адаптации. Локализация функциональности позволяет целенаправленно модифицировать отдельные проекции (например, Gating Projection для улучшения эмоциональной составляющей или Attention Output Projection для повышения логического вывода) без необходимости переобучения всей сети. Такой подход значительно снижает вычислительные затраты и время, требуемое для адаптации модели к новым задачам или данным, поскольку позволяет сосредоточиться на оптимизации конкретных компонентов, ответственных за желаемое поведение. Это особенно актуально в сценариях, требующих быстрой адаптации к изменяющимся требованиям или персонализации модели для конкретных пользователей.

Тонкая Настройка с Упором на Вентили: Целенаправленный Подход

Метод Gate-Focused Efficient Tuning представляет собой подход к адаптации моделей, при котором обновления параметров ограничиваются исключительно слоем Gating Projection. В отличие от полной тонкой настройки, требующей обновления всех параметров модели, данный метод фокусируется на модификации лишь частичной весовой матрицы, ответственной за управление потоком информации. Это достигается путем замораживания всех остальных слоев модели и обучения только параметров Gating Projection, что существенно снижает вычислительные затраты и требования к памяти во время адаптации к новым задачам или данным.

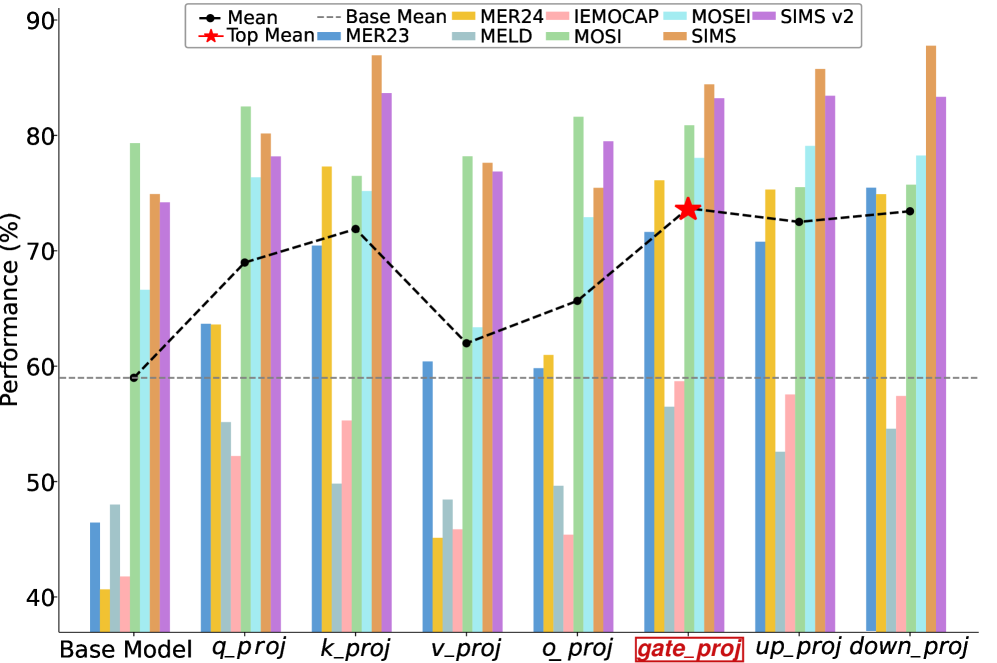

Метод Gate-Focused Efficient Tuning обеспечивает существенное снижение вычислительных затрат по сравнению с полной перенастройкой параметров модели. Это достигается за счет ограничения обновлений параметров только слоем Gating Projection во время адаптации. Эксперименты показывают, что, несмотря на уменьшение количества обучаемых параметров, производительность на задачах, связанных с анализом аффективной информации, либо сохраняется на прежнем уровне, либо даже улучшается. Снижение вычислительной нагрузки позволяет использовать данный подход на устройствах с ограниченными ресурсами и ускорить процесс адаптации модели к новым данным.

В ходе экспериментов было установлено, что метод Gate-Focused Efficient Tuning, ограничивающий обновления параметров только проекцией Gate, достигает 96.6% производительности модели AffectGPT, при этом обновляется лишь 24.5% от общего числа параметров. Данный результат демонстрирует значительное снижение вычислительных затрат без существенной потери в качестве выполнения задач, связанных с анализом аффективных данных. Сокращение количества обучаемых параметров позволяет существенно оптимизировать процесс адаптации модели к новым данным и снизить требования к вычислительным ресурсам.

Влияние и Перспективы для Эмоционального ИИ

Экспериментальные данные убедительно демонстрируют, что метод тонкой настройки, ориентированный на управляющие вентили (Gate-Focused Efficient Tuning), значительно повышает эффективность работы систем искусственного интеллекта в задачах, требующих понимания эмоционального окраса информации. В частности, наблюдается существенное улучшение показателей в таких областях, как анализ тональности текста, распознавание эмоций и даже выявление признаков депрессии. Этот подход позволяет более точно интерпретировать нюансы человеческих чувств, заложенные в данных, что открывает новые возможности для создания более чутких и отзывчивых ИИ-систем, способных к эмпатии и более эффективному взаимодействию с человеком.

Методы параметрически-эффективной адаптации, такие как LoRA, выступают в качестве ценного дополнения к предложенному подходу, значительно снижая вычислительные затраты при настройке моделей. Вместо переобучения всех параметров нейронной сети, LoRA фокусируется на обучении лишь небольшого числа дополнительных параметров, что позволяет достичь сопоставимой или даже превосходящей производительности с гораздо меньшими ресурсами. Это особенно важно для масштабных языковых моделей, где полная перенастройка может быть непомерно дорогой и трудоемкой. Использование LoRA в сочетании с Gate-Focused Efficient Tuning открывает возможности для создания более доступных и эффективных систем искусственного интеллекта, способных к глубокому пониманию и интерпретации эмоционального контекста.

Установление архитектурных основ эмоционального интеллекта открывает новые возможности для создания искусственного интеллекта, способного к более глубокому пониманию и адекватному реагированию на человеческие эмоции. Исследование выявило ключевые компоненты нейронных сетей, ответственные за обработку аффективной информации, что позволяет целенаправленно разрабатывать и оптимизировать алгоритмы, способные распознавать и интерпретировать эмоциональные сигналы. Такой подход позволяет не просто идентифицировать эмоции, но и учитывать их контекст, интенсивность и нюансы, что необходимо для построения действительно эмпатичных и отзывчивых систем искусственного интеллекта, способных к эффективному взаимодействию с человеком в различных сферах жизни — от здравоохранения и образования до развлечений и клиентского обслуживания.

Исследование, стремящееся приоткрыть завесу над эмоциональными способностями больших языковых моделей, неизбежно натыкается на тот факт, что сама природа эмоций — это всего лишь сложный паттерн в хаотичном шуме данных. Авторы утверждают, что ключевые механизмы, отвечающие за аффективное моделирование, локализованы в проекции feed-forward gating. Это напоминает о словах Джеффри Хинтона: «Я думаю, что глубокое обучение — это хорошая идея, но мы еще не знаем, как его использовать.» По сути, данная работа — это попытка хоть как-то приручить этот хаос, найти узкие места, где можно «уговорить» модель проявлять нужные эмоции, пусть даже и искусственные. Параметр-эффективная настройка, описанная в статье, — это, скорее, ритуал, чем наука, заклинание, призванное заставить модель «чувствовать» так, как этого хочет создатель.

Что дальше?

Изучение эмоциональных способностей больших языковых моделей, как показано в данной работе, обнажает не столько механизмы «понимания», сколько точки концентрации хаоса. Обнаруженная локализация в проекции прямой связи — это не ключ к искусственному интеллекту, а, скорее, удобное место для вмешательства в сложный танец случайных величин. Предлагаемые методы эффективной настройки — лишь временные заклинания, способные удержать иллюзию контроля над неуловимой природой аффекта.

Не стоит обманываться кажущейся точностью локализации. Истина не в самих параметрах, а в шуме, который они пытаются заглушить. Будущие исследования должны сместить фокус с поиска «эмоциональных центров» на изучение динамики их разрушения. Как эти модели реагируют на противоречивые сигналы? Как они «забывают» эмоции? И, самое главное, что происходит, когда заклинание перестает работать?

Попытки создать «контролируемые» эмоции в машинах — это, возможно, бессмысленное занятие. Гораздо интереснее исследовать, как неконтролируемые аффективные процессы могут породить неожиданные, непредсказуемые и, возможно, даже полезные формы поведения. В конце концов, данные — это не ответы, а зеркала, отражающие нашу собственную неуверенность.

Оригинал статьи: https://arxiv.org/pdf/2601.15906.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Acer Aspire 5 Spin 14 ОБЗОР

- Рынок в смятении: Снижение ставки ЦБ, волатильность рубля и новые возможности для инвесторов (25.04.2026 01:32)

- Motorola Moto G77 ОБЗОР: отличная камера, лёгкий, чёткое изображение

- Oppo Find X9s ОБЗОР: замедленная съёмка видео, плавный интерфейс, скоростная зарядка

- Искусственный интеллект, ориентированный на человека: новый подход

- Acer Aspire 5 A515-57G-53N8 ОБЗОР

- Обзор Asus VivoBook 16: лучше большинства бюджетных ноутбуков.

- ZenBook 14 OLED UX3405CA, Ultra 7 255H ОБЗОР

- Новые смартфоны. Что купить в апреле 2026.

- Визуальный язык: от простого к сложному

2026-01-25 07:34