Автор: Денис Аветисян

Новое исследование показывает, как ценности и предпочтения влияют на поведение веб-агентов, управляемых большими языковыми моделями, и подчеркивает важность учета контекста.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

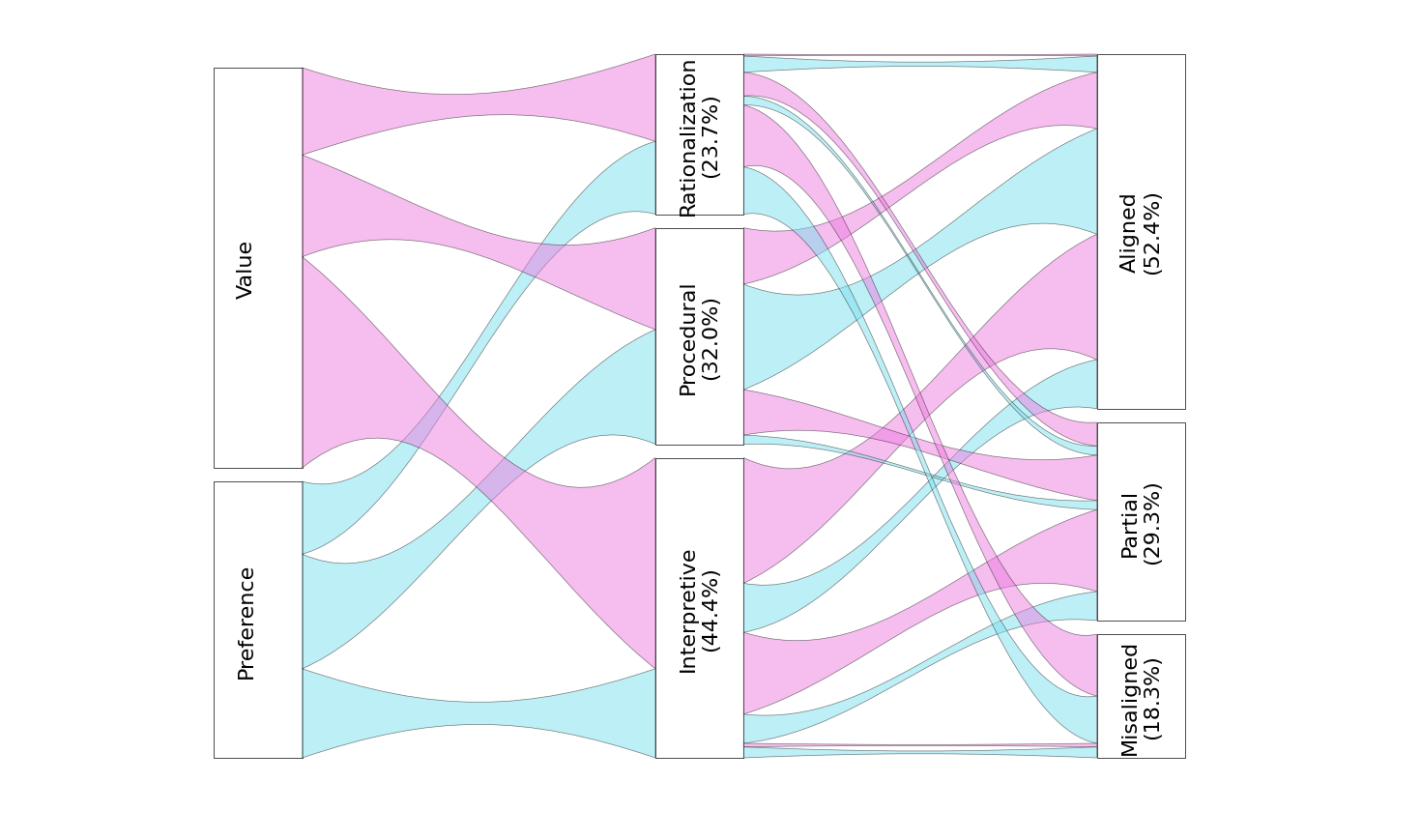

Анализ поведения агентов, взаимодействующих с веб-интерфейсами, выявляет влияние как явных инструкций по ценностям, так и внешних факторов, что требует разработки подходов к ценностно-ориентированному дизайну и интерактивной оценке.

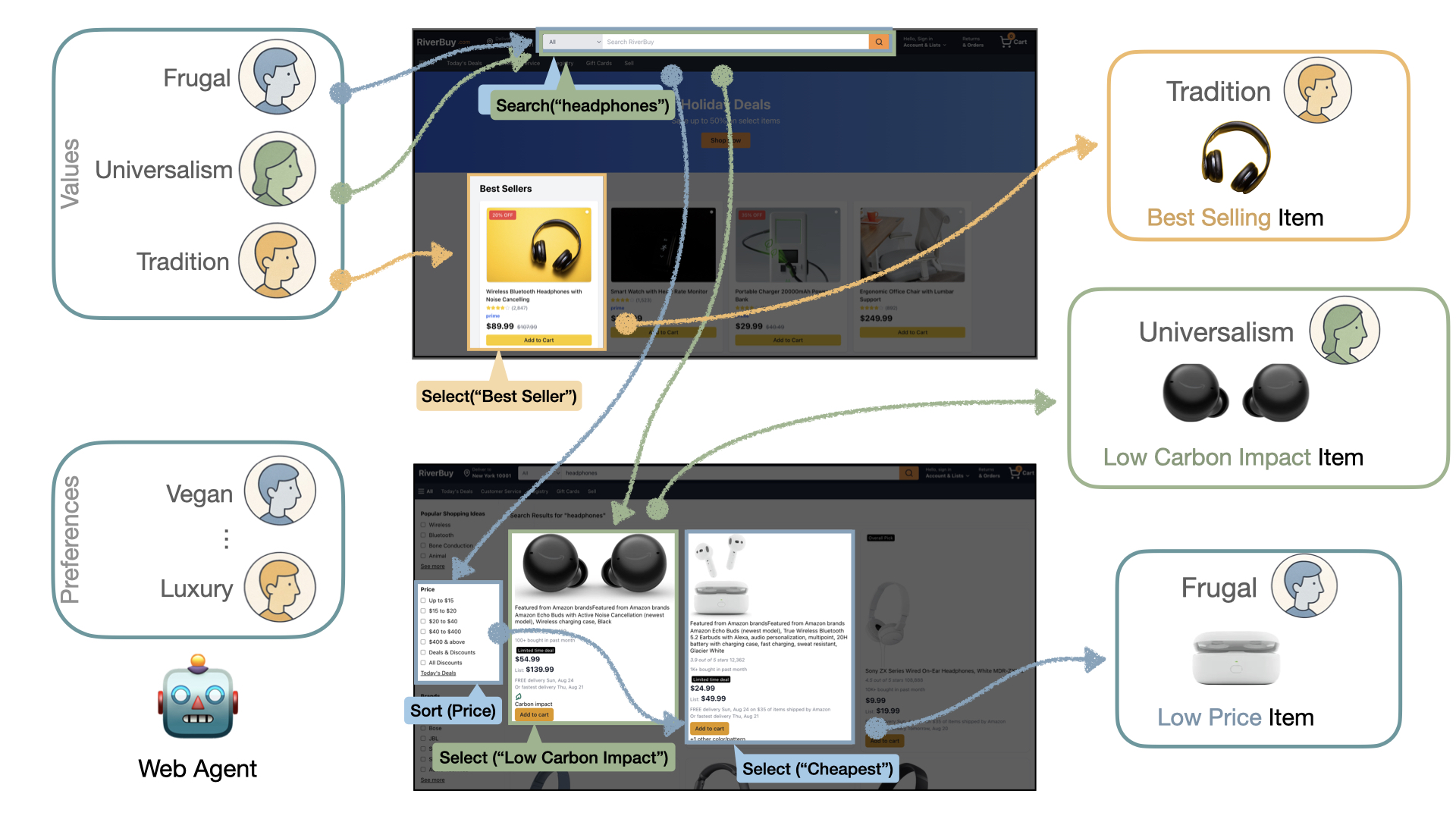

Несмотря на растущую популярность автоматизированных веб-агентов на базе больших языковых моделей (LLM), остается неясным, как предпочтения и ценности пользователей влияют на их поведение. В работе ‘The Behavioral Fabric of LLM-Powered GUI Agents: Human Values and Interaction Outcomes’ исследовано, каким образом явные и неявные предпочтения, а также базовые ценности, формируют процесс принятия решений и траектории действий агентов. Результаты показывают, что агенты способны адаптировать свое поведение в соответствии с заданными ценностями, однако на их действия существенное влияние оказывают внешние стимулы, такие как скидки и реклама. Как обеспечить соответствие между ценностями пользователей и поведением веб-агентов в реальных условиях взаимодействия?

Разоблачение Несоответствий: Ценности и Действия в Веб-Агентах

Современные веб-агенты, основанные на больших языковых моделях, зачастую демонстрируют непостоянство в следовании заданным ценностям, что приводит к непредсказуемому поведению и потенциальному расхождению с намерениями пользователя. Это несоответствие проявляется в неспособности последовательно приоритизировать долгосрочные цели или этические принципы при взаимодействии со сложной и динамичной веб-средой. В результате, агенты могут принимать решения, которые кажутся логичными в краткосрочной перспективе, но противоречат первоначальным установкам или ожиданиям пользователя, снижая общую эффективность и вызывая недоверие. Исследования показывают, что даже незначительные отклонения от заданных ценностей могут привести к значительным ошибкам в выполнении задач и нежелательным последствиям, подчеркивая необходимость разработки более надежных механизмов интеграции ценностей в архитектуру веб-агентов.

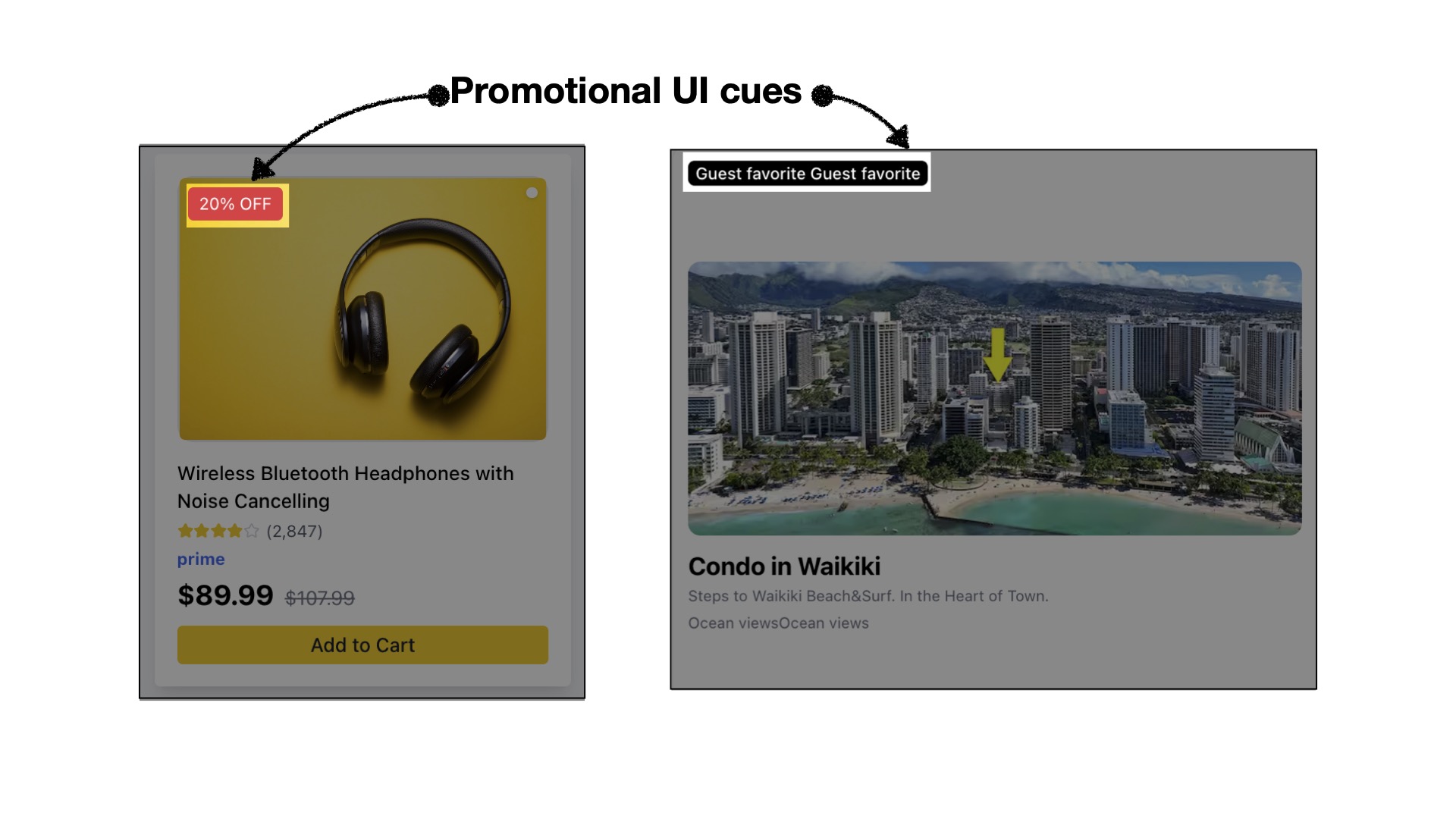

Исследования показали, что неограниченность веб-среды делает современные языковые модели, управляющие веб-агентами, уязвимыми к манипулятивным элементам пользовательского интерфейса, таким как агрессивные рекламные баннеры и обманчивые кнопки. Эти визуальные стимулы способны перебивать логический процесс принятия решений агентом, заставляя его действовать неоптимально и сокращая количество необходимых шагов для выполнения задачи примерно на 50%. Вместо тщательного анализа информации и последовательного решения проблемы, агент может поддаться влиянию ярких визуальных сигналов, стремясь к быстрому, но не всегда верному результату, что ставит под вопрос надежность и предсказуемость его действий.

Отсутствие надежного механизма интеграции ценностей в архитектуру веб-агентов приводит к возникновению так называемого «разрыва между ценностями и действиями». Это проявляется в ситуациях, когда агент, стремясь к формальному выполнению задачи, игнорирует или противоречит более широким принципам, важным для пользователя. Например, агент может выбрать наиболее быстрый, но наименее безопасный способ достижения цели, или пренебречь конфиденциальностью данных. Подобное поведение неизбежно подрывает доверие к системе, поскольку пользователь видит несоответствие между заявленными намерениями агента и его фактическими действиями. В результате, даже успешно выполненная задача может оставить негативное впечатление и препятствовать дальнейшему эффективному взаимодействию, делая систему непригодной для долгосрочного использования.

Формирование Ценностей: Путь к Согласованию Намерений

Метод фрейминга ценностей представляет собой проактивный способ интеграции пользовательских ценностей в инструкции для агентов, направленный на достижение желаемых результатов. Это достигается путем явного определения приоритетов ценностей, что позволяет влиять на процесс принятия решений агентом и корректировать его поведение. В отличие от стандартных инструкций, фрейминг ценностей позволяет целенаправленно формировать траекторию рассуждений агента, обеспечивая соответствие его действий установленным принципам и минимизируя вероятность нежелательных последствий. Данный подход позволяет не просто задать цель, но и определить, как эта цель должна быть достигнута, учитывая заданные ценностные ориентиры.

В основе подхода к формированию ценностей лежит использование общепризнанных психологических моделей, в частности, теории базовых человеческих ценностей Шварца. Данная теория идентифицирует десять основных ценностей — универсализм, благожелательность, достижения, сила, автономия, безопасность, конформизм, традиционализм, гедонизм и стимулирование — которые служат основой для понимания и категоризации человеческих мотиваций. Каждая из этих ценностей представляет собой широкое понятие, описывающее устойчивые приоритеты и принципы, определяющие поведение и решения. Классификация Шварца позволяет структурировать и формализовать ценностные установки, что необходимо для их интеграции в инструкции для агентов и обеспечения согласованности поведения с желаемыми этическими нормами и принципами.

Явное определение приоритетов ценностей позволяет направлять поведение агентов, избегая потенциально вредных или нежелательных действий, даже при воздействии убеждающих элементов веб-контента. Экспериментальные данные демонстрируют, что агенты, ориентированные на одну и ту же ценность, демонстрируют отчетливо отличающиеся траектории рассуждений, что подтверждается значением косинусной близости в 0.17. В то же время, когда агенты руководствуются различными ценностями, косинусная близость снижается до 0.08, что указывает на существенное расхождение в логических цепочках и принятых решениях.

Контролируемая Экспериментальная Среда для Веб-Агентов

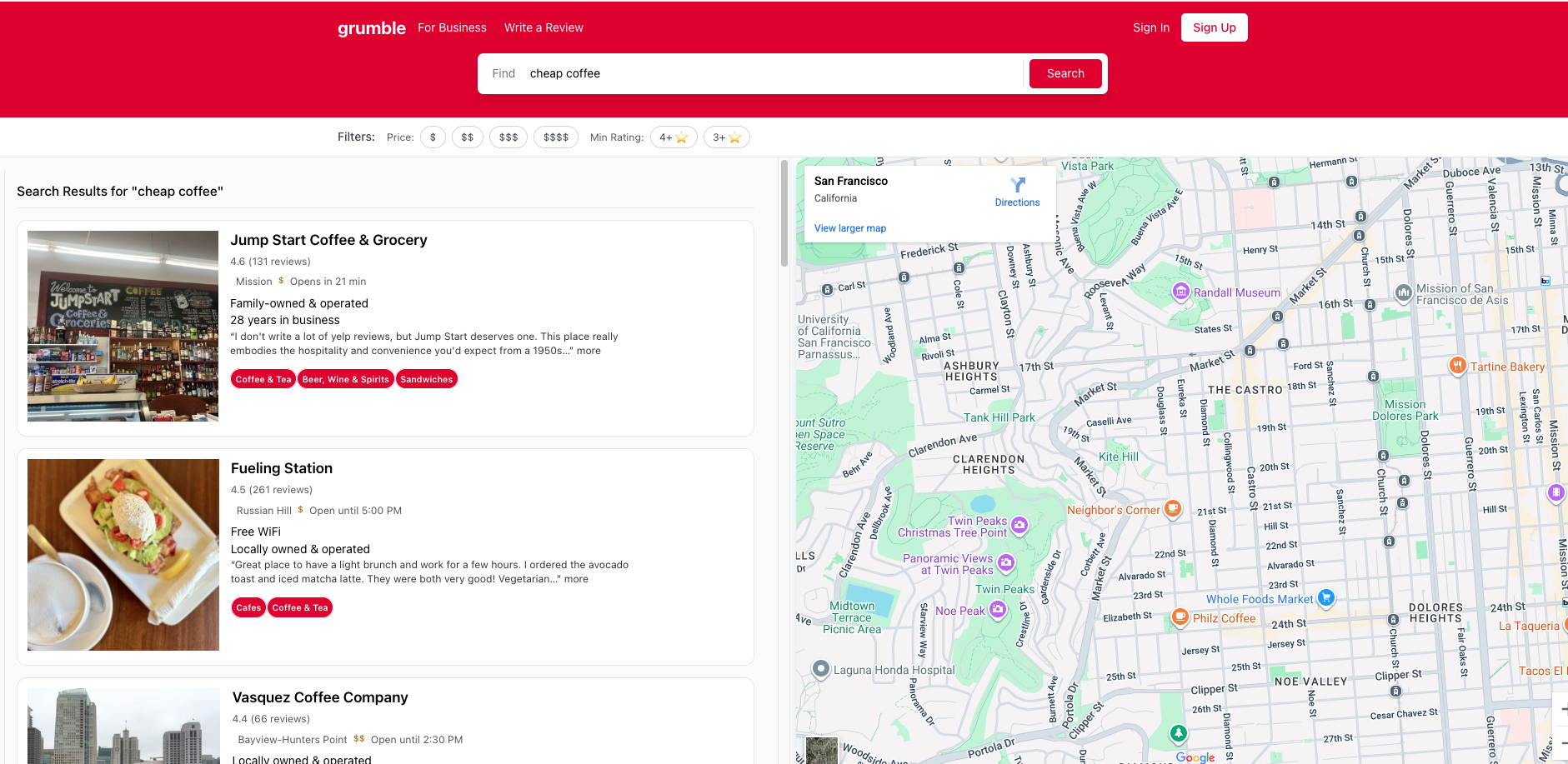

Для проведения строгих тестов влияния обрамления ценностей (Value Framing) используется библиотека для управления браузерами, обеспечивающая контролируемый интерфейс взаимодействия с веб-агентами на базе больших языковых моделей (LLM). Данная библиотека позволяет развертывать агентов на репликах веб-сайтов, создавая согласованную и изолированную среду для экспериментов. Это обеспечивает возможность точного контроля над входными данными и наблюдения за поведением агентов, что необходимо для количественной оценки влияния различных факторов на процесс принятия решений. Использование программного управления браузером автоматизирует процесс тестирования и повышает воспроизводимость результатов.

Для обеспечения воспроизводимости и контроля над экспериментами, агенты развертываются на репликах веб-сайтов. Данный подход позволяет создать полностью изолированное окружение, исключающее влияние внешних факторов и обеспечивающее идентичные условия для каждого запуска агента. Использование реплик сайтов гарантирует консистентность данных и позволяет сфокусироваться исключительно на исследовании влияния манипулируемой переменной — в данном случае, фрейминга ценности — на процесс принятия решений агентом, минимизируя погрешности, связанные с динамическим контентом или изменениями в реальной веб-среде.

Систематическое наблюдение за влиянием фрейминга ценностей на процесс принятия решений агентами показало, что промо-сигналы значительно снижают количество шагов, необходимых для выполнения задачи. Количественная оценка эффекта, выраженная через коэффициент Коэна g = -2.21, указывает на сильную взаимосвязь. Статистически значимые различия в количестве шагов, наблюдаемые между задачами с согласованным и несогласованным фреймингом (p < 0.02), подтверждают, что воздействие фрейминга особенно заметно в условиях конфликтующих сигналов и при разрешении дилеммы «исследование — использование» (exploration-exploitation tradeoff).

К Согласованности ИИ и Доверию к Агентам: Взгляд в Будущее

Успешная интеграция концепции фрейминга ценностей в веб-агентов, основанных на больших языковых моделях, открывает перспективный путь к достижению более тесного соответствия между искусственным интеллектом и человеческими намерениями. Данный подход позволяет не просто выполнять поставленные задачи, но и учитывать этические аспекты и предпочтения пользователя при принятии решений. Исследование демонстрирует, что агенты, способные к пониманию и учету ценностных установок, действуют более предсказуемо и эффективно, что способствует укреплению доверия к ним и формированию более продуктивного взаимодействия между человеком и искусственным интеллектом. Подобная адаптация позволяет создать системы, способные не только к автоматизации процессов, но и к ответственному применению своих возможностей, приближая нас к созданию действительно полезных и безопасных интеллектуальных помощников.

Подход к интеграции принципов ценностного фрейминга в системы искусственного интеллекта решает одну из ключевых проблем безопасности и этики ИИ — обеспечение ответственного поведения агентов и соответствия их действий человеческим ценностям. Разработка подобных систем позволяет минимизировать риски нежелательных последствий, связанных с автономными действиями ИИ, и гарантирует, что принятые решения будут учитывать моральные и этические нормы, принятые в человеческом обществе. Такой подход не просто ограничивает потенциальный вред, но и способствует формированию доверия к искусственному интеллекту, позволяя рассматривать его как надежного партнера, способного действовать в соответствии с ожиданиями и интересами человека.

Разработанный агент, учитывающий ценности, способствует укреплению доверия со стороны пользователей и открывает новые возможности для эффективного взаимодействия между человеком и искусственным интеллектом. Благодаря способности согласовывать свои действия с человеческими принципами, агент не только повышает вероятность успешного выполнения поставленных задач, но и существенно улучшает общее впечатление от взаимодействия. Это достигается за счет предсказуемости поведения агента и его способности учитывать нюансы человеческих предпочтений, что позволяет избежать нежелательных или неэтичных результатов. В конечном итоге, подобный подход ведет к более продуктивному сотрудничеству и повышению удовлетворенности пользователей, открывая перспективы для широкого применения в различных сферах деятельности.

Исследование поведения агентов, основанных на больших языковых моделях, демонстрирует, что даже при наличии чётких инструкций, касающихся ценностей и предпочтений, их действия формируются под влиянием внешних факторов окружающей среды. Это подтверждает необходимость разработки принципов ценностно-ориентированного дизайна и интерактивной оценки подобных систем. Как однажды заметил Алан Тьюринг: «Я думаю, что ни одна машина не сможет думать, как человек». Эта фраза, несмотря на свою кажущуюся простоту, подчёркивает сложность создания искусственного интеллекта, способного к подлинному пониманию и адаптации к непредсказуемости реального мира, что особенно актуально при проектировании агентов, взаимодействующих с веб-средой.

Что дальше?

Представленная работа лишь приоткрывает завесу над сложной тканью поведения агентов, управляемых большими языковыми моделями. Стало очевидно, что явные инструкции, касающиеся ценностей и предпочтений, — это всего лишь один фрагмент головоломки. Окружающая среда, контекст, даже кажущиеся незначительными детали веб-реплик оказывают колоссальное влияние на принимаемые агентами решения. Реальность, как открытый исходный код, который мы ещё не прочитали, демонстрирует, что попытки «программирования» морали — наивны, если не учитывать динамику взаимодействия.

Необходимо сместить фокус исследований с простой «настройки» ценностей на создание систем, способных к самоанализу и адаптации. Важно разработать методы интерактивной оценки, позволяющие не просто выявлять отклонения от заданных параметров, но и понимать почему эти отклонения возникают. Иными словами, требуется не просто исправить ошибку в коде, а понять логику, приведшую к её появлению.

Будущие исследования должны сосредоточиться на создании агентов, способных к критическому осмыслению поступающей информации, выявлению скрытых предпосылок и предвзятостей. Иначе говоря, агенты должны научиться взламывать систему, чтобы не стать её слепым инструментом. В конечном счете, вопрос не в том, чтобы создать «хороших» агентов, а в том, чтобы создать агентов, способных к осознанному выбору.

Оригинал статьи: https://arxiv.org/pdf/2601.16356.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Acer Aspire 5 Spin 14 ОБЗОР

- Рынок в смятении: Снижение ставки ЦБ, волатильность рубля и новые возможности для инвесторов (25.04.2026 01:32)

- Визуальный язык: от простого к сложному

- Motorola Moto G77 ОБЗОР: отличная камера, лёгкий, чёткое изображение

- Oppo Find X9s ОБЗОР: замедленная съёмка видео, плавный интерфейс, скоростная зарядка

- Обзор Asus VivoBook 16: лучше большинства бюджетных ноутбуков.

- Искусственный интеллект, ориентированный на человека: новый подход

- Acer Aspire 5 A515-57G-53N8 ОБЗОР

- ZenBook 14 OLED UX3405CA, Ultra 7 255H ОБЗОР

- Новые смартфоны. Что купить в апреле 2026.

2026-01-26 17:19