Автор: Денис Аветисян

Новая система PersonaCite позволяет создавать более достоверные и прозрачные ИИ-персоны, используя реальные данные о потребностях и мнениях пользователей.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

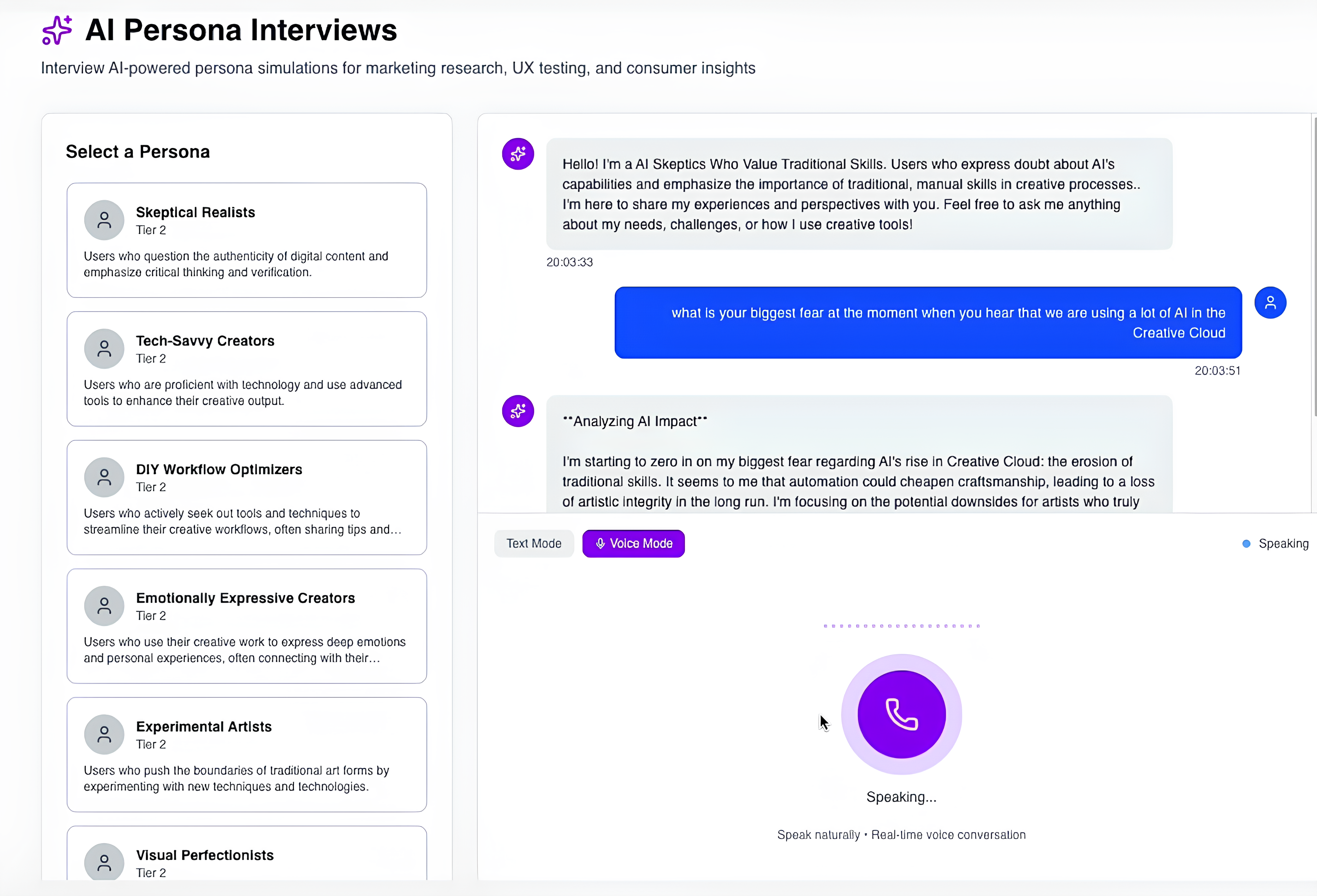

Исследование представляет систему, использующую данные Voice of Customer (VoC) для создания агентных синтетических ИИ-персон с возможностью верификации и смягчения галлюцинаций.

Несмотря на растущую популярность синтетических персон на основе больших языковых моделей в исследованиях и проектировании, часто возникает проблема непрозрачности и невозможности верификации предоставляемой ими информации. В данной работе, представленной в статье ‘PersonaCite: VoC-Grounded Interviewable Agentic Synthetic AI Personas for Verifiable User and Design Research’, предлагается система PersonaCite, которая обеспечивает привязку ответов персоны к реальным данным «голоса клиента» (VoC) в режиме реального времени. Это позволяет не только повысить достоверность результатов, но и явно указывать на пробелы в знаниях, обеспечивая прозрачность и ответственность при использовании ИИ в процессах проектирования. Какие новые подходы к документированию и оценке достоверности ИИ-персон необходимы для их эффективной интеграции в исследовательские практики?

Истинный лик искусственного интеллекта: преодолевая разрыв между данными и ответами

Традиционные искусственные личности, создаваемые для взаимодействия с пользователями, часто страдают от недостатка опоры на реальные данные, что приводит к спекулятивным и неточным ответам. Отсутствие прочной основы в достоверной информации подрывает доверие к таким системам, поскольку пользователи сталкиваются с откликами, не имеющими подтверждения в фактах или опыте. Эта проблема особенно актуальна в контексте сложных запросов, требующих глубокого понимания предметной области, где неточные сведения могут привести к ошибочным выводам или нежелательным последствиям. В результате, эффективность и полезность подобных искусственных личностей снижается, а потенциальные возможности для продуктивного взаимодействия остаются нереализованными.

Распространение персон, созданных на основе больших языковых моделей (LLM), усугубляет проблему достоверности. Эти модели, обладая впечатляющей способностью генерировать текст, склонны к “галлюцинациям” — выдаче ложной или недостоверной информации, представленной как факт. Отсутствие надежных ограничений и механизмов проверки приводит к тому, что LLM-персоны могут свободно конструировать вымышленные детали, приписывать себе несуществующие знания или давать ответы, не имеющие под собой реальной основы. Это не только подрывает доверие пользователей, но и создает серьезные риски в контекстах, где требуется высокая точность и надежность информации, например, в образовании или здравоохранении.

Современные подходы к созданию искусственных личностей сталкиваются с существенной проблемой: разрыв между абстрактными ответами, генерируемыми моделями, и конкретными данными, полученными от реальных пользователей. Существующие методы зачастую не способны эффективно связать теоретические конструкции с практическим опытом, что приводит к нерелевантным или неточным ответам. Несмотря на значительный прогресс в области обработки естественного языка, системы испытывают трудности в интерпретации нюансов человеческого поведения и адаптации к индивидуальным особенностям каждого пользователя. В результате, искусственные личности могут казаться поверхностными или неправдоподобными, подрывая доверие и затрудняя эффективное взаимодействие. Необходимы инновационные решения, позволяющие более точно сопоставлять абстрактные модели с эмпирическими данными, чтобы создавать действительно аутентичные и полезные виртуальные личности.

PersonaCite: Опора на голос клиента для создания достоверных личностей

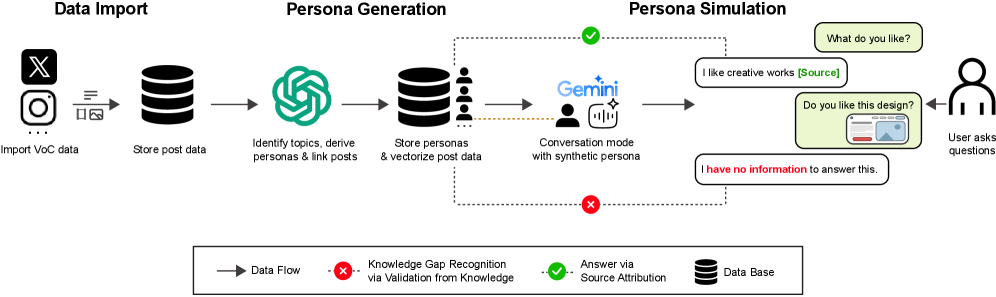

Система PersonaCite разработана для реализации принципа привязки данных (data grounding), гарантируя, что генерируемые ответы напрямую связаны с подтвержденными данными голоса клиента (VoC Data). Это достигается путем интеграции источников VoC данных в процесс генерации ответов, что позволяет системе предоставлять не только информацию, но и конкретные доказательства, подтверждающие ее достоверность. Фактически, PersonaCite обеспечивает возможность отслеживания происхождения каждого утверждения до первоисточника данных, что повышает надежность и прозрачность предоставляемой информации.

Система PersonaCite использует технологию Agentic Context Engineering для извлечения и представления релевантных доказательств, подтверждающих ответы, генерируемые персонами. Этот подход предполагает активный поиск и включение конкретных данных из источников обратной связи от клиентов (VoC) непосредственно в контекст ответа. Представление подтверждающих данных повышает достоверность и полезность информации, предоставляемой системой, позволяя пользователям не только получать ответ, но и видеть его обоснование, основанное на реальных данных о клиентах.

Система PersonaCite была разработана в течение трех месяцев как внутренний инновационный проект. Она объединяет возможности генеративного искусственного интеллекта с принципами доказательной аргументации, что позволяет обеспечить обоснованность и достоверность ответов. Валидация системы проводилась с привлечением 14 экспертов в областях UX-исследований, управления продуктами, дизайна и стратегии искусственного интеллекта, что обеспечило соответствие PersonaCite требованиям практического применения и потребностям пользователей.

Прозрачность и надежность: отслеживание источников и признание незнания

Система PersonaCite обеспечивает отслеживаемость ответов посредством атрибуции источника, связывая каждый с конкретным артефактом «Голоса Клиента» (VoC), на котором он основан. Эта функциональность позволяет пользователям верифицировать информацию и понимать контекст, из которого она получена. Привязка к исходным данным VoC повышает доверие к ответам, предоставляя возможность проследить логику и обоснованность генерации информации, а также обеспечивает ответственность системы за предоставляемые сведения.

Система PersonaCite реализует механизм явного воздержания от ответа (Explicit Abstention), позволяя персонам признавать недостаточность знаний для формирования ответа на конкретный запрос. Вместо генерации потенциально вводящей в заблуждение информации, система идентифицирует случаи, когда подтвержденные данные из артефактов VoC отсутствуют, и предоставляет пользователю соответствующее уведомление о невозможности предоставления обоснованного ответа. Данный подход направлен на повышение надежности системы и предотвращение распространения недостоверной информации.

В процессе разработки PersonaCite были проведены индивидуальные экспертные интервью длительностью от 30 минут до 1 часа посредством видеоконференций в Teams. Данные интервью были направлены на сбор всесторонней обратной связи и валидацию функций прозрачности системы, включая атрибуцию источников и механизм явного отказа от ответа при отсутствии необходимой информации. Такой подход позволил обеспечить соответствие системы требованиям пользователей и повысить доверие к предоставляемым ответам.

Расширение горизонтов пользовательских исследований: моделирование реакций синтетических пользователей

Система PersonaCite предоставляет возможность моделирования реакций пользователей, позволяя дизайнерам представлять различные стимулы синтетическим пользователям и прогнозировать наиболее вероятные ответы. Этот процесс выходит за рамки традиционных методов исследования, предоставляя возможность быстрого прототипирования и итеративного улучшения дизайна. Вместо проведения дорогостоящих и трудоемких пользовательских тестов, специалисты могут оперативно оценивать эффективность новых решений, опираясь на данные, лежащие в основе созданных персонажей. Таким образом, PersonaCite позволяет существенно ускорить цикл разработки, обеспечивая более точное соответствие продукта потребностям целевой аудитории и повышая вероятность успешного внедрения.

Возможность моделирования реакций синтетических пользователей значительно расширяет границы традиционных исследований пользовательского опыта. Вместо длительных и дорогостоящих процессов набора участников и проведения юзабилити-тестирований, дизайнеры получают инструмент для оперативной проверки гипотез и итеративного улучшения прототипов. Это позволяет быстро выявлять потенциальные проблемы с интерфейсом и функциональностью на ранних стадиях разработки, снижая риски и затраты на последующие исправления. Такой подход особенно ценен в условиях динамично меняющихся требований и необходимости выпуска продуктов в сжатые сроки, предоставляя возможность непрерывной оптимизации и адаптации к потребностям целевой аудитории.

Вместо создания абстрактных, теоретических профилей пользователей, современные исследования всё чаще опираются на данные, полученные из реального поведения целевой аудитории. Такой подход позволяет формировать более детализированные и правдоподобные «персоны», отражающие не только демографические характеристики, но и мотивации, предпочтения и типичные сценарии взаимодействия с продуктом. Эти данные-ориентированные персоны, в отличие от гипотетических, дают возможность глубже понять потребности пользователей, предвидеть их реакции и, как следствие, создавать более эффективные и удобные решения, точно соответствующие запросам целевой аудитории.

Исследование демонстрирует, что системы искусственного интеллекта, подобные PersonaCite, неизбежно подвержены влиянию времени и данных, на которых они обучаются. Как отмечает Роберт Таржан: «Структуры данных и алгоритмы должны быть спроектированы так, чтобы их можно было легко адаптировать к изменяющимся требованиям». Подобно тому, как архитектура программного обеспечения эволюционирует, PersonaCite стремится к адаптации через постоянную привязку к данным Voice of Customer (VoC), минимизируя галлюцинации и повышая прозрачность. Этот подход позволяет системе не просто отвечать на вопросы, а подтверждать свои ответы реальными доказательствами, тем самым признавая и учитывая собственные ограничения в знаниях. Система, привязанная к данным VoC, стремится к достойному старению, сохраняя свою релевантность и полезность с течением времени.

Что дальше?

Представленная работа демонстрирует, как можно временно замедлить энтропию в системах, создавая иллюзию достоверности через привязку к данным «голоса клиента». Однако, стоит признать: любая такая привязка — лишь отсрочка неизбежного. Система PersonaCite, как и любая другая, сталкивается с фундаментальной проблемой: задержка, неизбежный налог на каждый запрос, и конечное, ограниченное количество доступных данных. Стабильность, которую она демонстрирует, — это иллюзия, закешированная временем.

Будущие исследования, вероятно, сосредоточатся не на попытках создать «идеальные» личности, а на разработке методов прозрачного признания границ этих систем. Вместо маскировки недостатка знаний, стоит стремиться к явной демонстрации неполноты, к четкому указанию на те области, где система «не знает» или где её данные устарели. Иначе, мы лишь усложняем задачу выявления галлюцинаций, делая их более изощренными.

В конечном счете, вопрос не в том, насколько убедительны созданные нами симуляции, а в том, как мы используем их ограниченные возможности. Все системы стареют — вопрос лишь в том, делают ли они это достойно, признавая свою конечность и передавая знания о своих ограничениях.

Оригинал статьи: https://arxiv.org/pdf/2601.22288.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Acer Aspire 5 Spin 14 ОБЗОР

- Huawei nova 15 Max ОБЗОР

- Oppo Find X9s Pro ОБЗОР: скоростная зарядка, современный дизайн, замедленная съёмка видео

- ВИ.РУ акции прогноз. Цена VSEH

- Российский рынок: от оттока наличных к смешанной динамике и ожиданиям ЦБ (07.05.2026 20:32)

- vivo iQOO Z10x ОБЗОР: яркий экран, удобный сенсор отпечатков, объёмный накопитель

- Wiko Hi Enjoy 60s ОБЗОР: быстрый сенсор отпечатков, большой аккумулятор

- Российский рынок: дефляция, рубль и геополитика – обзор ключевых событий недели (06.05.2026 19:32)

- Подтверждена дата глобального запуска серии Oppo Find X8

- Люди платят 650 долларов сверх рекомендованной розничной цены за Lenovo Legion Go 2, потому что его почти невозможно найти — и, честно говоря, я понимаю, это лучший портативный игровой ПК 2025 года.

2026-02-03 00:21