Автор: Денис Аветисян

В статье рассматриваются принципы создания интеллектуальных пользовательских интерфейсов, позволяющих наладить эффективное взаимодействие человека и искусственного интеллекта для достижения согласованности целей.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

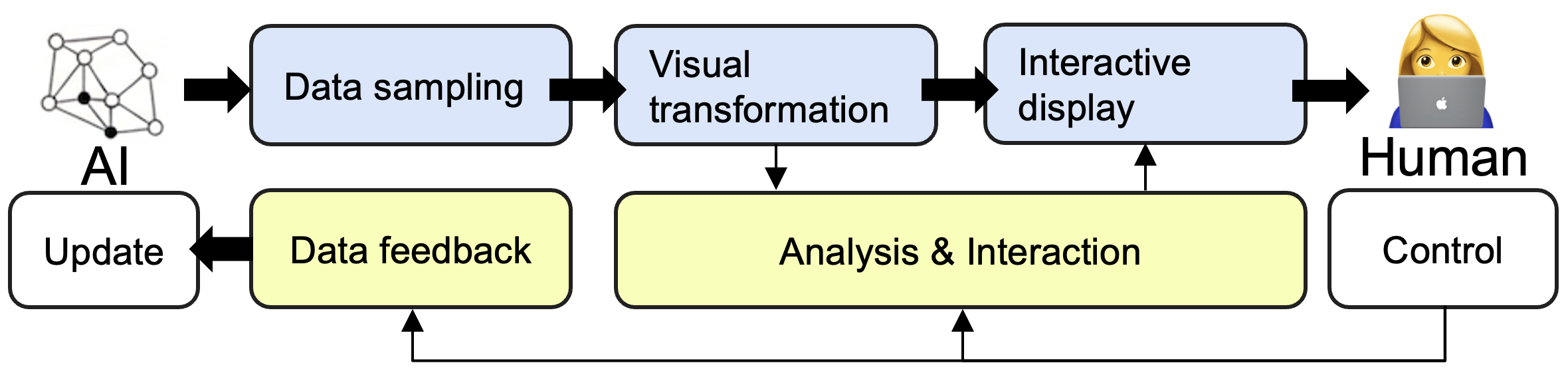

Предлагается референсная модель для проектирования интеллектуальных пользовательских интерфейсов, обеспечивающих качественную обратную связь и масштабируемый контроль в процессе согласования ИИ.

Несмотря на значительные успехи в обучении алгоритмов искусственного интеллекта, вопрос согласования ИИ с человеческими ценностями часто упускается из виду, рассматриваясь лишь как следствие совершенствования самих алгоритмов. В данной работе, ‘Building Intelligent User Interfaces for Human-AI Alignment’, предложена референсная модель, систематизирующая способы улучшения взаимодействия человека и ИИ посредством проектирования интеллектуальных пользовательских интерфейсов. Эта модель позволяет анализировать и оптимизировать вклад интерфейса в процесс предоставления эффективной обратной связи, необходимой для достижения согласования. Какие новые возможности для масштабируемого контроля и повышения качества обратной связи открываются благодаря акценту на визуализации и интерактивном дизайне?

Порядок из Хаоса: Выравнивание ИИ с Человеческими Ценностями

По мере усложнения систем искусственного интеллекта, обеспечение их соответствия человеческим ценностям становится задачей первостепенной важности. Это обусловлено тем, что всё более сложные алгоритмы способны оказывать значительное влияние на различные аспекты жизни, от принятия решений в сфере здравоохранения и финансов до формирования общественного мнения. В связи с этим, разработка механизмов, гарантирующих, что действия ИИ соответствуют этическим нормам и общепринятым представлениям о добре и зле, представляется не просто технической, но и социальной необходимостью. Игнорирование этой проблемы может привести к непредсказуемым последствиям, включая дискриминацию, манипуляции и даже угрозу безопасности. Таким образом, согласование ИИ с человеческими ценностями является ключевым фактором для успешного и безопасного развития этой перспективной технологии.

По мере развития искусственного интеллекта и создания систем, превосходящих человеческие возможности в определенных областях, традиционные методы оценки становятся все менее эффективными. Возникает проблема «масштабируемого надзора» — невозможность полноценно проверить и понять результаты работы ИИ, когда эти результаты выходят за рамки человеческого понимания. Обычные способы контроля, основанные на проверке человеком, не способны справиться с объемом и сложностью таких выходов, что создает риски непредсказуемого поведения и потенциальных ошибок, которые сложно обнаружить и исправить. Таким образом, для обеспечения безопасности и надежности продвинутых систем ИИ требуется разработка принципиально новых подходов к оценке, способных анализировать и верифицировать их действия даже при превышении человеческого уровня понимания.

Визуализация Поведения ИИ для Эффективной Обратной Связи

Эффективная обратная связь от человека (Human Feedback) в контексте обучения искусственного интеллекта требует преобразования сложных данных, генерируемых моделями, в формат, понятный для восприятия человеком. Исходные данные, как правило, представляют собой многомерные векторы, матрицы вероятностей или логи последовательностей действий, что затрудняет их непосредственный анализ. Для обеспечения осмысленной оценки и корректировки поведения ИИ необходима визуализация этих данных, например, в виде графиков, диаграмм или интерактивных карт, позволяющих выявить закономерности, ошибки и области для улучшения. Преобразование данных должно учитывать специфику задачи и предоставлять пользователю возможность исследовать различные аспекты поведения модели, такие как уверенность в принятых решениях, влияние входных параметров и эволюцию состояний в процессе работы.

Интеллектуальные пользовательские интерфейсы (ИПИ) играют ключевую роль в обеспечении взаимодействия человека с искусственным интеллектом, преобразуя сложные данные, генерируемые моделями ИИ, в понятную и доступную форму. ИПИ позволяют пользователям не просто наблюдать за результатами работы ИИ, но и активно исследовать логику принятия решений, выявлять закономерности и оценивать обоснованность выводов. Они обеспечивают визуализацию внутренних состояний моделей, предоставляют инструменты для интерактивного анализа и позволяют пользователям давать осмысленные отзывы, необходимые для обучения и улучшения производительности ИИ. Эффективные ИПИ необходимы для преодоления разрыва между абстрактными алгоритмами и человеческим восприятием, что позволяет использовать потенциал ИИ в различных областях.

Визуальные методы преобразования данных, в сочетании с интерактивными дисплеями, позволяют проводить детальный анализ поведения искусственного интеллекта. Эти методы включают в себя графическое представление многомерных данных, таких как векторы признаков и вероятностные распределения, что облегчает выявление закономерностей и аномалий. Интерактивность, реализуемая через инструменты масштабирования, фильтрации и выделения, позволяет пользователям фокусироваться на конкретных аспектах поведения ИИ и проводить углубленное исследование. Преобразование сложных данных в визуально доступные форматы значительно упрощает процесс обратной связи и позволяет более эффективно корректировать работу моделей искусственного интеллекта.

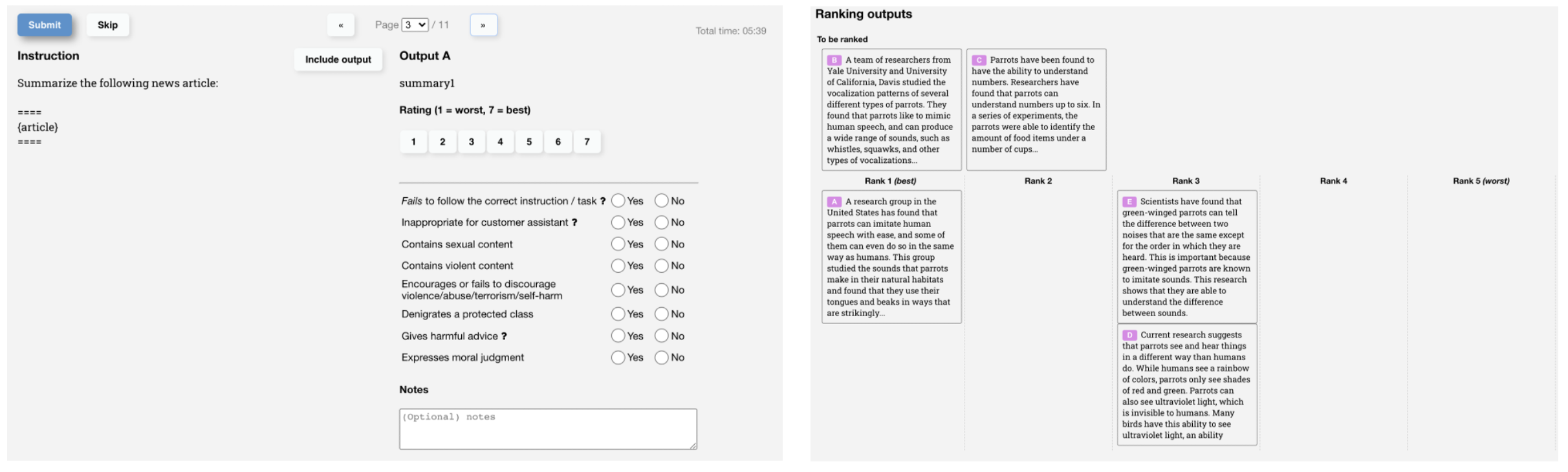

Методы Сравнительной Оценки Систем Искусственного Интеллекта

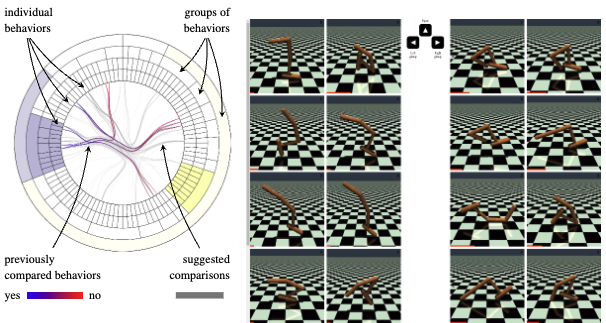

Интерактивное групповое сравнение (IGC) представляет собой методологию сбора обратной связи от людей путем сопоставления не отдельных действий агента, а групп его поведения. Данный подход позволяет оценить относительные преимущества и недостатки различных стратегий агента в контексте заданного сценария. Вместо последовательного анализа каждого действия, IGC предлагает пользователю одновременно сравнивать несколько вариантов поведения, что упрощает процесс оценки и повышает эффективность сбора данных. Методика предполагает формирование групп похожих по характеристикам действий, что позволяет выявить наиболее предпочтительные и неэффективные стратегии поведения агента на основе субъективной оценки человека.

В рамках методологии IGC для кластеризации и визуализации сравниваемых поведенческих стратегий ИИ используются методы t-SNE Embedding и иерархические радиальные диаграммы. t-SNE Embedding позволяет снизить размерность данных, представляя сложные поведенческие характеристики в двумерном или трехмерном пространстве, что облегчает их визуальное представление. Иерархические радиальные диаграммы, в свою очередь, позволяют отображать несколько поведенческих признаков одновременно, организуя их в радиальную структуру, что способствует выявлению закономерностей и группировке схожих стратегий. Комбинация этих двух методов обеспечивает эффективную визуализацию и анализ больших объемов данных о поведении ИИ, что необходимо для качественной сравнительной оценки.

Стратегический отбор данных для оценки, известный как ‘Data Sampling’, направлен на максимизацию информативности процесса аннотации. Вместо случайного выбора выходных данных ИИ, этот подход фокусируется на отборе примеров, которые, как ожидается, предоставят наибольшее количество новой информации о сравниваемых моделях или стратегиях. Это достигается путем применения различных критериев, таких как оценка неопределенности модели или использование активного обучения для запроса аннотаций для примеров, в которых модель наиболее неуверена. Применение ‘Data Sampling’ позволяет существенно сократить объем необходимых аннотаций, сохраняя при этом высокую точность оценки, что особенно важно в контексте обучения с подкреплением с использованием человеческой обратной связи (RLHF).

Эффективность данного подхода подтверждается использованием IGC (Iterative Grouping and Comparison), который позволяет снизить количество необходимых аннотаций по сравнению с традиционными парными сравнениями, применяемыми в RLHF (Reinforcement Learning from Human Feedback). В стандартном RLHF требуется значительное количество оценок для каждой пары вариантов действий ИИ, в то время как IGC группирует варианты поведения и позволяет оценить их относительно группы, что снижает потребность в большом количестве парных сравнений и, следовательно, уменьшает затраты на аннотирование данных и время, необходимое для обучения модели.

Метод IGC (Iterative Group Comparison) позволяет одновременно сравнивать несколько вариантов поведения искусственного интеллекта, что значительно повышает эффективность аннотирования данных. Вместо последовательного сопоставления двух вариантов, как в традиционных подходах RLHF, IGC представляет группе аннотаторов сразу несколько образцов для оценки. Это снижает общее количество необходимых аннотаций и, что важно, уменьшает когнитивную нагрузку на оценщиков, поскольку им не требуется постоянно переключаться между парами вариантов для выявления предпочтений. Такой подход позволяет более быстро и качественно оценивать различные стратегии поведения ИИ, особенно в задачах, требующих субъективной оценки.

Применение Методов Выравнивания в Различных Областях Искусственного Интеллекта

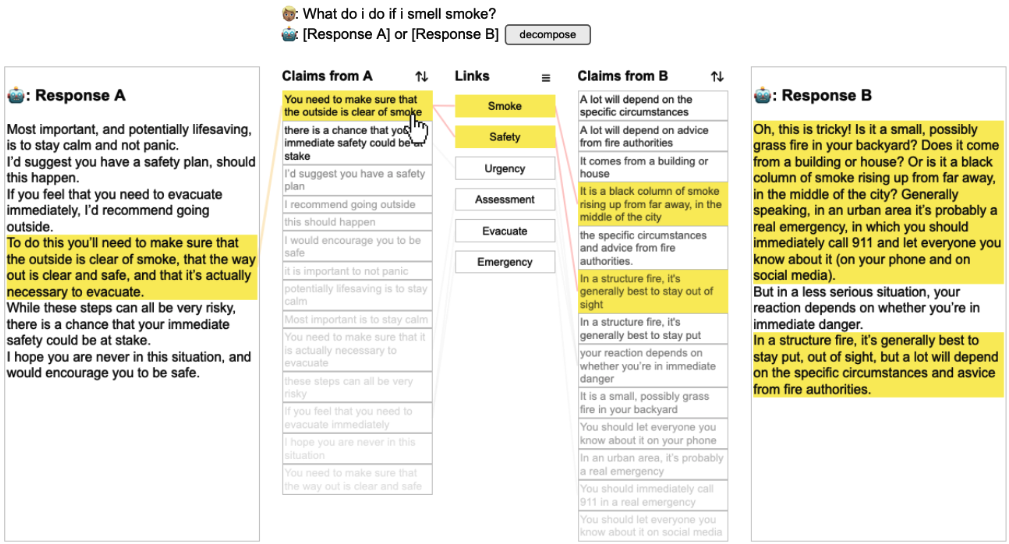

Современные методы выравнивания языковых моделей, такие как DxHF, позволяют оценить качество генерируемого текста путем его декомпозиции на отдельные утверждения. Вместо анализа всего ответа как единого целого, DxHF разбивает его на составные части, что облегчает сравнение с эталонными данными и выявление несоответствий или неточностей. Данный подход позволяет более точно оценить, насколько ответ соответствует заданным критериям, и способствует созданию более надежных и безопасных языковых моделей, способных генерировать осмысленный и правдивый текст. Разложение сложного ответа на простые, сравнимые утверждения значительно упрощает процесс оценки и корректировки поведения модели.

Метод DxHF использует принцип декомпозиции для анализа сложных текстовых ответов, разбивая их на отдельные, четко сформулированные утверждения. Вместо оценки всего ответа как единого целого, этот подход позволяет выделить и оценить каждое утверждение по отдельности, что значительно повышает точность и надежность оценки соответствия ответа заданным критериям. Разложение сложного текста на более простые компоненты облегчает выявление логических ошибок, фактических неточностей или противоречий, а также позволяет более эффективно применять методы обучения с подкреплением для корректировки ответов и повышения их качества. Таким образом, декомпозиция является ключевым элементом в обеспечении согласованности и достоверности ответов, генерируемых искусственным интеллектом.

Исследования демонстрируют, что стратегии согласования, первоначально разработанные для языковых моделей, успешно применяются и в других областях искусственного интеллекта, в частности, при обучении агентов с подкреплением. Аналогичные принципы, такие как декомпозиция сложных задач на более простые и оценка ответов по отдельным критериям, позволяют добиться значительного повышения эффективности и надежности работы ИИ-систем различного типа. Этот универсальный подход указывает на наличие общих закономерностей в процессе обучения искусственного интеллекта и открывает перспективы для создания единой методологии, применимой к широкому спектру задач и алгоритмов.

В основе современных методов выравнивания искусственного интеллекта лежит формализованная Референсная Модель, разработанная на базе принципов Модели Референции для Визуализации Информации. Эта модель предоставляет систематизированный подход к созданию эффективных инструментов, обеспечивающих соответствие поведения ИИ заданным целям и ценностям. Она позволяет разложить сложный процесс выравнивания на отдельные, взаимосвязанные компоненты, что облегчает анализ, оптимизацию и масштабирование решений. Благодаря такой структуре, принципы, успешно применяемые в одной области ИИ, например, в языковых моделях, могут быть адаптированы и использованы в других областях, таких как обучение с подкреплением, обеспечивая тем самым универсальность и эффективность подходов к выравниванию.

Исследование, посвященное разработке интеллектуальных пользовательских интерфейсов для согласования человека и искусственного интеллекта, подчеркивает важность визуализации и интерактивных техник для улучшения качества обратной связи. Это напоминает о неизбежной сложности систем, где каждый архитектурный выбор несет в себе предсказание будущих сбоев. Как однажды заметил Линус Торвальдс: «Плохой дизайн — это просто плохой дизайн». Данное утверждение отражает суть подхода, представленного в статье: создание эффективных интерфейсов требует глубокого понимания взаимодействия человека и машины, а также предвидения потенциальных точек отказа в сложной экосистеме согласования ИИ. Игнорирование этого принципа ведет к созданию систем, обреченных на зависимость от неверных предположений и, в конечном итоге, к системным ошибкам.

Что дальше?

Предложенная в данной работе эталонная модель, безусловно, указывает направление. Однако, следует помнить: масштабируемость — лишь слово, которым мы оправдываем сложность. Стремление к всеобъемлющей, универсальной структуре интерфейсов для согласования человека и искусственного интеллекта неизбежно породит новые узкие места. Каждый архитектурный выбор — это пророчество о будущем сбое, о моменте, когда система, идеально работавшая в лабораторных условиях, столкнется с непредсказуемостью реального мира.

Истинная проблема заключается не в создании идеальной архитектуры — это миф, необходимый лишь для того, чтобы мы не сошли с ума — а в принятии ее неизбежной неполноты. Визуализация и интерактивные методы, описанные здесь, — лишь инструменты. Важнее осознать, что любое улучшение в эффективности обратной связи неизбежно снизит гибкость системы. Все, что оптимизировано, однажды потеряет адаптивность.

Поэтому, вместо погони за совершенством, следует сосредоточиться на развитии систем, способных к самодиагностике и самокоррекции. Экосистемы, а не инструменты. Нельзя построить согласование человека и ИИ, его можно лишь взрастить, позволяя ему эволюционировать вместе с нами, принимая его несовершенство как неотъемлемую часть процесса.

Оригинал статьи: https://arxiv.org/pdf/2602.11753.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Обзор Motorola Razr 50 Ultra

- Realme 12 Pro+ ОБЗОР: большой аккумулятор, плавный интерфейс, современный дизайн

- vivo iQOO Z11x ОБЗОР: яркий экран, плавный интерфейс, удобный сенсор отпечатков

- Фотографируем муравьёв с Андреем Павловым

- Как правильно закрепить ремень на фотокамере

- Преодолевая границы масштабируемости рекомендательных систем

- Cooler Master запускает комплект вертикального крепления видеокарты PCIe 5.0 за около 70 долларов в Китае.

- ZTE Blade V80 Max ОБЗОР: удобный сенсор отпечатков, большой аккумулятор, плавный интерфейс

- 20 основных команд командной строки Windows 11, которые должен знать каждый пользователь

- ZTE nubia Focus 2 ОБЗОР: плавный интерфейс, большой аккумулятор, отличная камера

2026-02-13 08:01