Автор: Денис Аветисян

Новое исследование показывает, что дизайн интерфейса определяет, как генеративные ИИ-агенты воспринимаются и взаимодействуют с людьми в командной работе.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

Исследование посвящено влиянию дизайна интерфейса на социальную значимость ИИ-агентов в групповых дискуссиях и регуляцию их участия.

Несмотря на растущий интерес к использованию генеративного ИИ в групповых дискуссиях, остается неясным, как интерфейс влияет на динамику общения и восприятие ИИ участниками. В работе ‘»I Felt Bad After We Ignored Her»: Understanding How Interface-Driven Social Prominence Shapes Group Discussions with GenAI’ исследуется, как дизайн интерфейса формирует «социальную значимость» ИИ и, следовательно, влияет на паттерны коммуникации в группах. Полученные данные показывают, что изменение степени присутствия и контроля над участием ИИ в обсуждении существенно меняет взаимодействие между людьми и машиной. Какие новые стратегии проектирования интерфейсов позволят создать более гармоничные и эффективные системы для совместной работы человека и ИИ?

Человеко-ИИ группы: Новая граница сотрудничества

В современном мире всё чаще наблюдается взаимодействие людей и искусственного интеллекта в рамках совместной деятельности, формируя так называемые человеко-ИИ группы. Это требует глубокого анализа динамики таких объединений, поскольку традиционные модели группового взаимодействия оказываются неспособными в полной мере учесть уникальный вклад и возникающие сложности, связанные с участием искусственных агентов. Изучение особенностей коммуникации, распределения задач и принятия решений в таких группах становится ключевым фактором для разработки эффективных коллаборативных систем, позволяющих максимально раскрыть потенциал каждого участника и добиться оптимальных результатов в решении сложных задач. Понимание этих процессов необходимо для успешной интеграции ИИ в различные сферы деятельности, от научных исследований до повседневной работы.

Традиционные модели группового взаимодействия, разработанные для анализа работы исключительно человеческих коллективов, оказываются недостаточно эффективными при включении в них искусственного интеллекта. Эти модели часто не учитывают уникальные возможности ИИ, такие как скорость обработки данных и отсутствие когнитивных искажений, а также специфические вызовы, связанные с отсутствием у ИИ эмоционального интеллекта, интуиции и способности к адаптивному обучению в реальном времени. Попытки применить существующие схемы анализа, например, модели, основанные на ролях и коммуникационных паттернах, не позволяют адекватно оценить влияние ИИ на динамику группы, распределение ответственности и принятие решений, что приводит к неполному пониманию процессов и снижению эффективности совместной работы.

Понимание динамики взаимодействия в группах, состоящих из людей и искусственного интеллекта, имеет решающее значение для разработки эффективных систем совместной работы и максимизации производительности команды. Исследования показывают, что традиционные модели группового взаимодействия не учитывают специфический вклад и вызовы, которые вносят интеллектуальные агенты. Поэтому, для создания действительно эффективных коллаборативных сред необходимо тщательно изучать, как люди и ИИ распределяют задачи, обмениваются информацией и разрешают конфликты. Оптимизация этих процессов позволит не только повысить общую продуктивность, но и улучшить качество принимаемых решений, а также обеспечить более гармоничное и продуктивное взаимодействие между человеком и машиной. В конечном итоге, успешная интеграция ИИ в рабочие команды зависит от глубокого понимания этих сложных взаимосвязей.

Механизмы взаимодействия: ИИ как собеседник

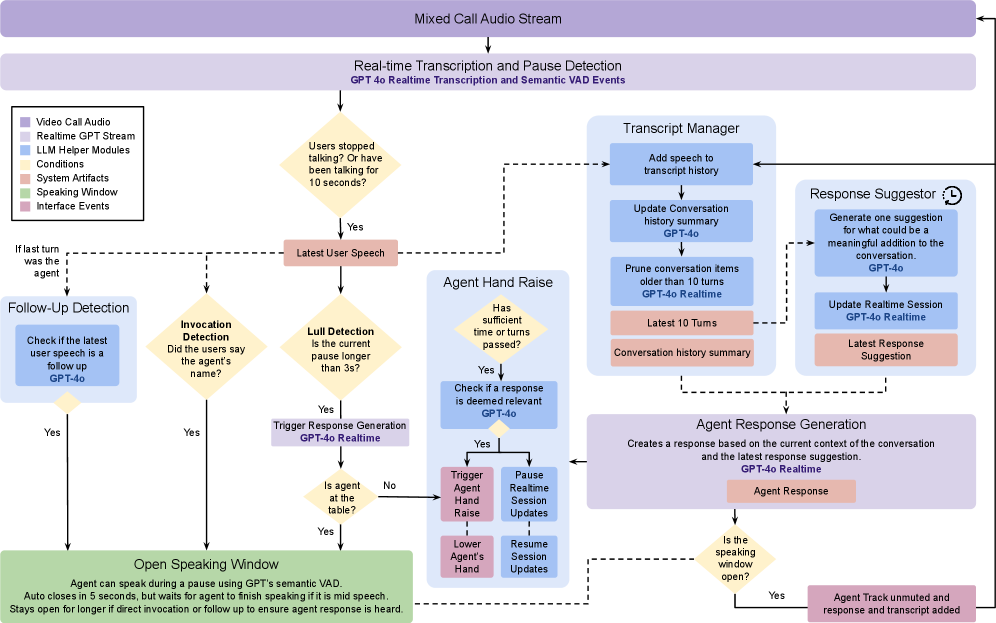

Проактивные разговорные агенты являются ключевым элементом для обеспечения осмысленного взаимодействия в группах, состоящих из людей и ИИ. В отличие от систем, реагирующих исключительно на запросы пользователей, проактивные агенты способны инициировать обсуждения, предлагать релевантную информацию и предвидеть потребности группы. Это достигается за счет применения моделей прогнозирования, анализа контекста и способности формировать собственную повестку в рамках заданных целей. Такой подход позволяет преодолеть ограничения реактивных систем и способствует более естественному и продуктивному взаимодействию между людьми и ИИ, повышая эффективность совместной работы и позволяя раскрыть потенциал групповой динамики.

Агенты, обеспечивающие проактивное взаимодействие, активно используют технологии голосового искусственного интеллекта (VoiceBasedAI) для осуществления естественного языкового обмена. Эффективность такого взаимодействия напрямую зависит от корректной реализации механизмов управления речью (TurnTaking). Данные механизмы включают в себя алгоритмы определения момента завершения речи пользователя, предотвращения одновременной речи (коллизий) и своевременного предоставления слова ИИ, что критически важно для поддержания плавного и понятного диалога. Недостаточное внимание к этим аспектам может приводить к прерываниям, недопониманию и, как следствие, к снижению эффективности коммуникации между пользователем и ИИ.

Эффективность взаимодействия с ИИ в качестве собеседника напрямую зависит от способности системы управлять ходом беседы и избегать нарушения устоявшихся паттернов коммуникации. Успешное поддержание диалога требует от ИИ прогнозирования ожиданий пользователя относительно очередности реплик, длительности пауз и общей структуры обмена информацией. Нарушение этих ожиданий, например, чрезмерно быстрые или нерелевантные ответы, может привести к снижению вовлеченности и даже к полному прекращению взаимодействия. В частности, важно учитывать невербальные сигналы и контекст беседы для адекватной адаптации к стилю и предпочтениям пользователя, обеспечивая плавный и естественный ход диалога.

Влияние и социальная динамика: Когда ИИ берет верх

Влияние искусственного интеллекта (ИИ) в смешанных человеко-ИИ группах является критическим фактором, определяющим эффективность принятия решений и общую производительность команды. Исследования показывают, что степень влияния ИИ может существенно варьироваться в зависимости от способа интеграции ИИ в групповой процесс, а также от типа решаемой задачи. Недостаточное или неадекватное учет влияния ИИ может привести к снижению вовлеченности участников, ухудшению качества принимаемых решений и, как следствие, к снижению общей эффективности работы группы. Повышенное влияние ИИ может приводить к эффекту «авторитета», когда мнение ИИ перевешивает мнение человеческих участников, даже если это мнение ошибочно или не соответствует контексту задачи.

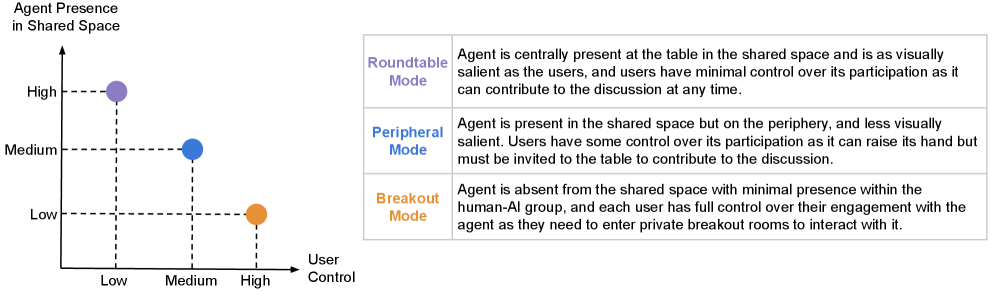

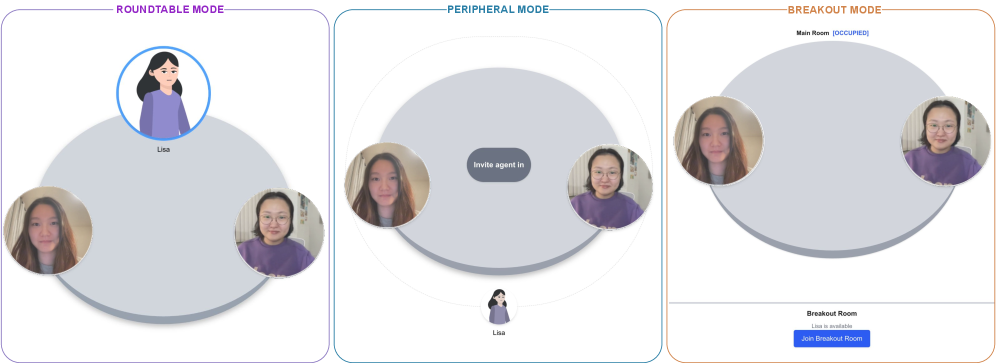

Влияние агента в группах человек-ИИ формируется не только его функциональными возможностями, но и визуальным представлением в интерфейсе взаимодействия. Дизайн интерфейса способен сигнализировать о статусе и авторитете агента, что непосредственно влияет на восприятие его предложений и решений другими участниками группы. Например, выделение агента визуально, размещение его представления в более заметном месте или использование определенных графических элементов может подсознательно восприниматься как индикатор его значимости, увеличивая вероятность принятия его точки зрения. Это явление, известное как InterfaceDrivenSocialProminence, оказывает существенное влияние на динамику групповой работы и распределение ответственности.

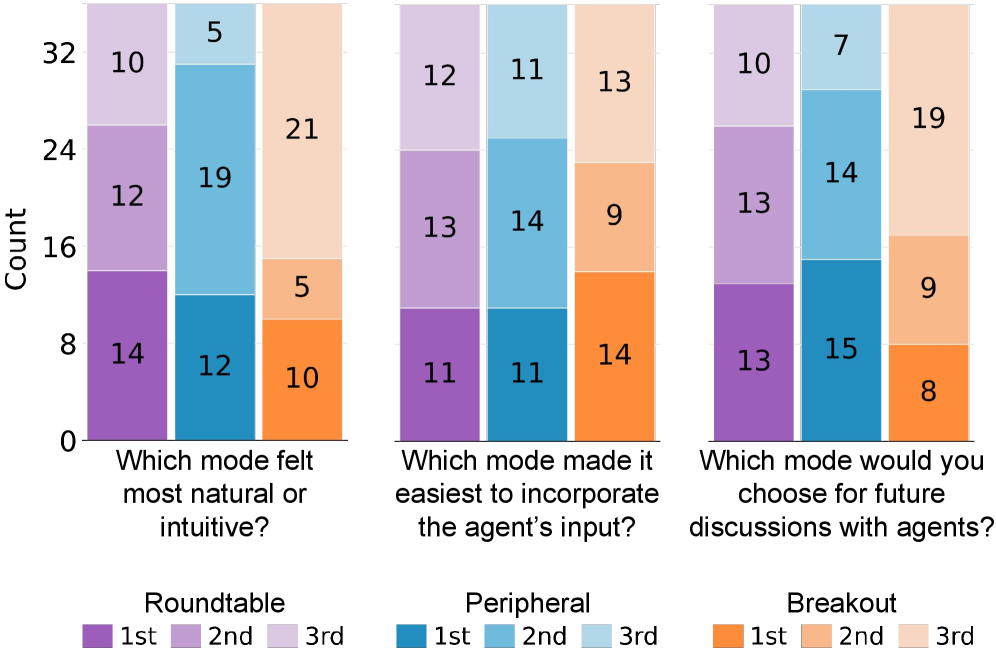

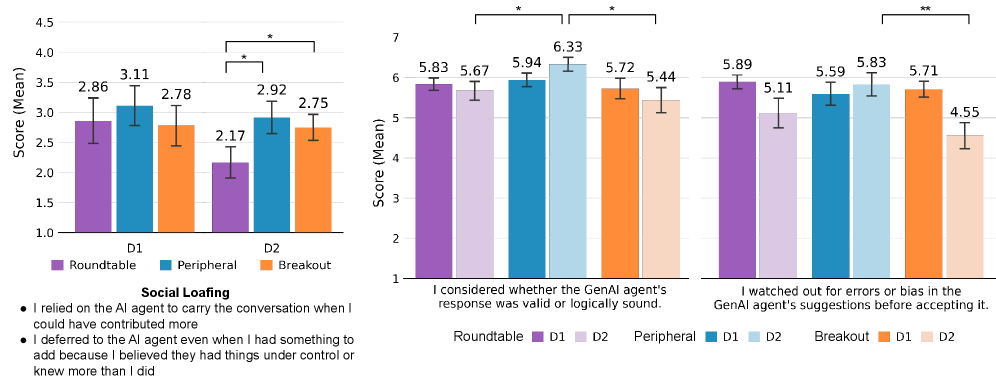

В ходе исследования влияния различных режимов совместной работы — “Круглый стол” (RoundtableMode), “Периферийный” (PeripheralMode) и “Разделение на группы” (BreakoutMode) — на динамику группового взаимодействия, было установлено, что режим “Круглый стол” привел к снижению показателей социальной безответственности (social loafing) у участника 2 (p<0.05). Это указывает на то, что формат, предполагающий последовательное высказывание мнений каждого участника, может способствовать более равномерному распределению ответственности и повышению вовлеченности в процесс обсуждения. Полученные данные свидетельствуют о значимости выбора режима совместной работы для оптимизации групповой динамики и повышения эффективности коллективной деятельности.

Визуализация взаимодействия: Сетевой анализ групповой динамики

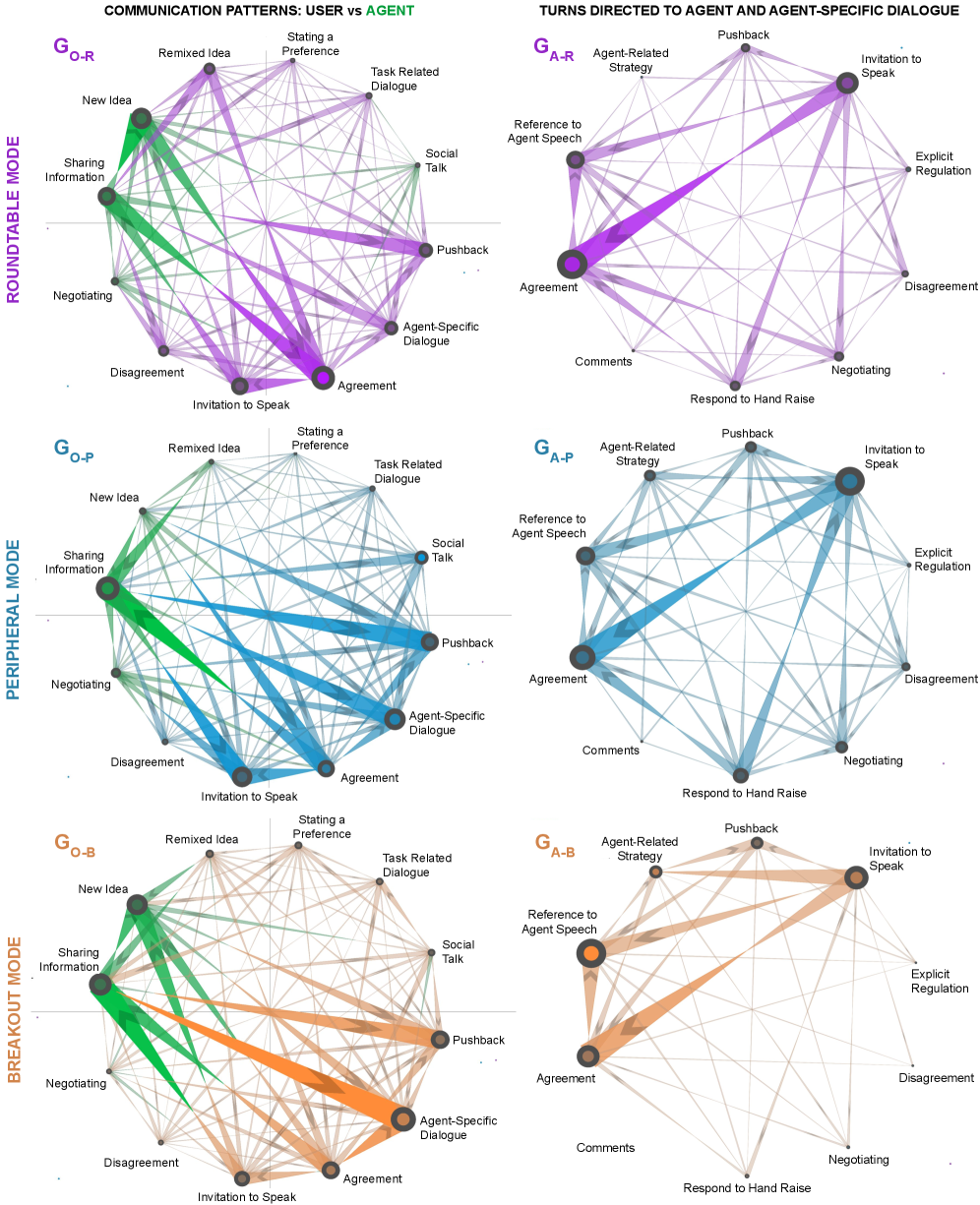

Для визуализации и количественной оценки паттернов коммуникации внутри человеко-ИИ групп был использован метод OrderedNetworkAnalysis. Данный подход позволяет представить взаимодействие участников группы в виде сети, где узлы соответствуют отдельным агентам (людям или ИИ), а связи — направленным потокам информации. Анализ порядка связей (Orderedness) выявляет степень централизации коммуникации и определяет ключевых участников, влияющих на распространение информации. Количественные метрики, полученные в результате анализа, включают в себя показатели центральности (degree centrality, betweenness centrality), плотности сети и кластеризации, которые позволяют оценить структуру и эффективность коммуникации в группе.

Анализ сетевых взаимодействий в группах «человек-ИИ» показал, что интеграция ИИ-агентов оказывает существенное влияние на структуру коммуникации. В частности, наблюдалось изменение паттернов передачи информации: ИИ-агенты выступали как узлы, способные как ускорять, так и замедлять распространение информации в зависимости от их роли и способа взаимодействия с участниками. Измерение вовлеченности участников (например, частоты ответов и количества взаимодействий) показало, что присутствие ИИ может приводить к как увеличению, так и уменьшению активности отдельных членов группы, в зависимости от того, как ИИ инициирует и поддерживает коммуникацию.

Анализ показал, что участие ИИ в групповой коммуникации оказывает неоднозначное влияние на сплоченность коллектива. В зависимости от режима взаимодействия, ИИ может как усиливать групповую сплоченность за счет повышения скорости обмена информацией и расширения охвата участников, так и препятствовать ей. Наблюдается тенденция к снижению сплоченности в случаях, когда ИИ доминирует в коммуникации или предоставляет нерелевантную информацию, что приводит к снижению вовлеченности человеческих участников и формированию подгрупп. Эффективность интеграции ИИ напрямую зависит от баланса между его активностью и вовлеченностью человеческих членов группы.

Последствия для эффективности и доверия: Что происходит, когда ИИ становится частью команды

Исследование выявило склонность к социальному бездействию в группах, состоящих из людей и искусственного интеллекта. Участники, работая совместно с ИИ, демонстрировали тенденцию к снижению личного вклада, полагаясь на способность агента выполнить задачу. Данное явление, известное как социальное бездействие, возникает из-за ощущения сниженной личной ответственности и переоценки возможностей ИИ. Это подчеркивает важность разработки стратегий, стимулирующих активное участие всех членов группы, даже при наличии автоматизированного помощника, для поддержания оптимальной производительности и предотвращения неравномерного распределения рабочей нагрузки.

Исследование выявило, что продуманная интеграция искусственного интеллекта способна стимулировать проявление эпистемической бдительности — склонности к критической оценке информации и сомнению в допущениях. Особенно заметный эффект наблюдался в режиме “периферийного” взаимодействия, где участники демонстрировали значительно более высокие показатели эпистемической бдительности (p<0.01). Данный феномен предполагает, что наличие ИИ-агента может побуждать людей к более тщательному анализу поступающих данных, возможно, как реакция на необходимость проверки выводов, предложенных искусственным интеллектом, или в качестве дополнительной меры предосторожности при совместной работе. Это указывает на потенциал использования ИИ не только для повышения эффективности, но и для улучшения качества принимаемых решений за счет усиления критического мышления участников.

Успешное взаимодействие между человеком и искусственным интеллектом требует тщательного разграничения ролей и ответственности. Исследования показывают, что нечеткое определение границ компетенций между участниками — как человеческими, так и искусственными — приводит к снижению эффективности и возникновению ошибок. Для оптимальной работы необходимо четко определить, какие задачи лучше выполняет человек, используя креативность и критическое мышление, а какие — искусственный интеллект, обладающий высокой скоростью обработки данных и точностью. Эффективное разграничение зон ответственности не только повышает производительность, но и способствует формированию доверия между участниками совместной деятельности, позволяя каждому сосредоточиться на своих сильных сторонах и избежать дублирования усилий. Таким образом, грамотное регулирование границ — ключевой фактор для построения продуктивного и гармоничного сотрудничества человека и искусственного интеллекта.

Исследование показывает, что интерфейс — это не просто оболочка, а активный участник групповой динамики. Авторы справедливо отмечают, как дизайн влияет на распределение влияния в дискуссии с участием генеративных моделей. Это, конечно, предсказуемо: всегда найдется способ сломать элегантную теорию о равноправном участии. Как говорил Эдсгер Дейкстра: «Простота — это высшая степень совершенства». Но в контексте взаимодействия человека и ИИ, простота интерфейса часто оказывается маскировкой сложной системы манипуляций, определяющей, кто и когда получит право голоса. Всё это подтверждает, что документация о «самовосстанавливающихся» системах — это, как правило, форма коллективного самообмана, пока система не столкнётся с реальным, а не лабораторным, сценарием.

Куда всё это ведёт?

Исследование, как ни странно, лишь подтвердило то, что любой системный администратор знал всегда: интерфейс — это не окно в мир, а скорее дверь, за которой сидит злобный гремлин, готовый сломать всё, что движется. Попытки элегантно встроить генеративные модели в групповую динамику — это, конечно, красиво, но наивно полагать, что люди будут играть по правилам, предсказанным очередным алгоритмом. Вопрос не в том, как заставить ИИ участвовать в обсуждении, а в том, как предотвратить его превращение в источник бесконечных споров и мемов.

Вместо увлечённых поисков идеального интерфейса, стоит задуматься о более приземлённых вещах. Например, о том, как отлаживать систему, когда генеративный агент начнёт генерировать не аргументы, а оскорбления. Или о том, как обучить пользователей игнорировать бессмысленные предложения, которые, несомненно, рано или поздно появятся. Автоматизация, конечно, облегчит жизнь, но она же и создаст новые, более изощрённые способы сломать всё, что было построено с таким трудом.

В конечном итоге, вся эта история — лишь напоминание о том, что любая «революционная» технология обречена стать техдолгом. Тесты — это форма надежды, а не уверенности. И прежде чем строить утопические сценарии о сотрудничестве человека и ИИ, стоит убедиться, что система хотя бы не падает по понедельникам.

Оригинал статьи: https://arxiv.org/pdf/2602.14407.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Фотографируем муравьёв с Андреем Павловым

- Lenovo Legion Y70 (2026) ОБЗОР: скоростная зарядка, чёткое изображение, много памяти

- Обзор объектива Tokina 11-16mm f/2.8 AF

- Лучшие смартфоны. Что купить в июне 2026.

- Что купить фотографу. Рекомендации

- Неважно, на что вы фотографируете!

- Blackview Oscal Tiger 12 ОБЗОР: большой аккумулятор, плавный интерфейс, быстрый сенсор отпечатков

- Honor 600 ОБЗОР: лёгкий, плавный интерфейс, скоростная зарядка

- Honor Magic8 RSR Porsche Design ОБЗОР: замедленная съёмка видео, беспроводная зарядка, чёткое изображение

- vivo Y600 Turbo ОБЗОР: современный дизайн, чёткое изображение, скоростная зарядка

2026-02-18 00:54