Автор: Денис Аветисян

Новый подход к расширению входных данных позволяет значительно ускорить процесс оптимизации нейронных сетей без увеличения вычислительных затрат.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

Предлагается аппаратный способ расширения входных данных для устранения симметрии параметров и повышения эффективности оптимизации LBFGS.

Оптимизация нейронных сетей для аппроксимации одномерных функций часто затруднена плоскими областями в пространстве параметров, что замедляет сходимость и ухудшает обобщающую способность. В работе ‘Hardware-Friendly Input Expansion for Accelerating Function Approximation’ предложен аппаратный подход к аппроксимации функций посредством расширения входного пространства, вдохновленный принципом разрушения симметрии из физики. Основная идея заключается в добавлении константных значений к исходному входу, формируя вектор большей размерности, что позволяет эффективно нарушить симметрии параметров без увеличения числа параметров сети. Может ли предложенный метод стать основой для разработки более эффективных и экономичных алгоритмов машинного обучения в широком спектре задач?

Скрытая Симметрия: Препятствие в Обучении Нейронных Сетей

Нейронные сети, несмотря на свою впечатляющую способность к обучению и решению сложных задач, зачастую сталкиваются с проблемой, связанной с симметрией параметров. Эта симметрия проявляется в том, что различные конфигурации параметров могут давать одинаковый результат, что приводит к избыточности в процессе оптимизации. Представьте себе, что сеть пытается найти оптимальный путь, но из-за симметрии существует множество эквивалентных путей, и алгоритм обучения тратит время, исследуя их все. В результате, обучение замедляется, требуется больше итераций для достижения желаемой точности, и потенциальная производительность сети может быть ограничена. Данная проблема особенно актуальна для сложных архитектур и больших объемов данных, где симметрия может значительно затруднить эффективную настройку параметров и достижение оптимальных результатов.

Симметрии в структуре нейронных сетей часто приводят к избыточным обновлениям параметров в процессе обучения. Это происходит потому, что несколько различных наборов весов могут давать одинаково хорошие результаты, что заставляет алгоритм оптимизации тратить вычислительные ресурсы на исследование эквивалентных решений. В результате, сходимость к оптимальным параметрам замедляется, а потенциальная производительность сети может быть ограничена, поскольку алгоритм неэффективно использует доступные данные. Такое явление особенно заметно при решении сложных задач, где даже незначительное увеличение времени обучения может существенно повлиять на общую эффективность модели и требуемые вычислительные мощности.

Традиционные методы оптимизации, такие как оптимизатор LBFGS, не учитывают присущие нейронным сетям симметрии параметров, что приводит к неэффективности обучения. Исследования показали, что при использовании LBFGS для обучения моделей, подверженных симметриям, требуется на 12% больше итераций для достижения сходимости по сравнению с подходами, специально разработанными для устранения этих симметрий. Это увеличение числа итераций напрямую влияет на время обучения и вычислительные ресурсы, необходимые для достижения оптимальной производительности модели. Неспособность LBFGS эффективно справляться с симметриями приводит к избыточным обновлениям параметров, замедляя процесс обучения и потенциально ограничивая способность модели к обобщению.

Нарушение Симметрии: Расширение Входного Пространства

Расширение входного пространства (Input-Space Expansion) представляет собой метод, направленный на устранение симметрии параметров в процессе обучения моделей. Этот подход реализуется путем искусственного увеличения объема входных данных, что позволяет обойти ограничения, возникающие из-за симметричных свойств исходных данных. По сути, это дополнение входных данных новыми значениями, что приводит к снижению избыточности, вызванной симметрией, и способствует более эффективной оптимизации параметров модели.

Постоянное заполнение (Constant Padding) реализуется путем добавления фиксированных значений по краям входных данных, что эффективно увеличивает размер входного пространства. Данный подход направлен на снижение избыточности, вызванной симметрией параметров модели. Увеличение размерности входных данных позволяет различать ранее эквивалентные входные примеры, что приводит к более эффективному использованию параметров и снижению количества итераций, необходимых для достижения сходимости алгоритма оптимизации, например, в алгоритме LBFGS.

Введение асимметрии во входные данные способствует более разнообразным и эффективным обновлениям параметров в процессе обучения. Этот подход позволяет снизить избыточность, вызванную симметрией параметров, и тем самым ускорить сходимость алгоритма оптимизации. В ходе тестирования было установлено, что применение данной техники приводит к сокращению количества итераций, необходимых для работы алгоритма LBFGS, на 12%.

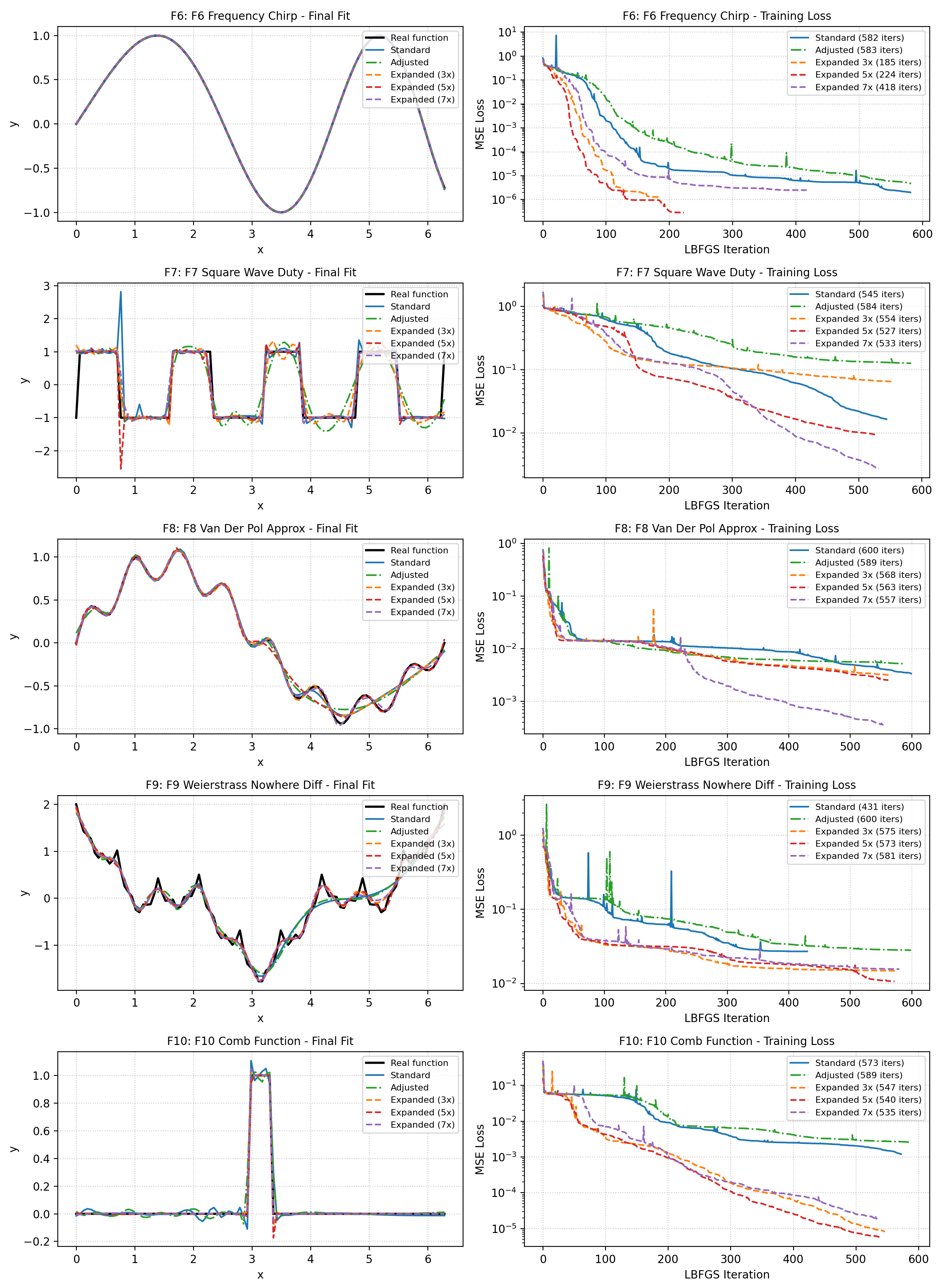

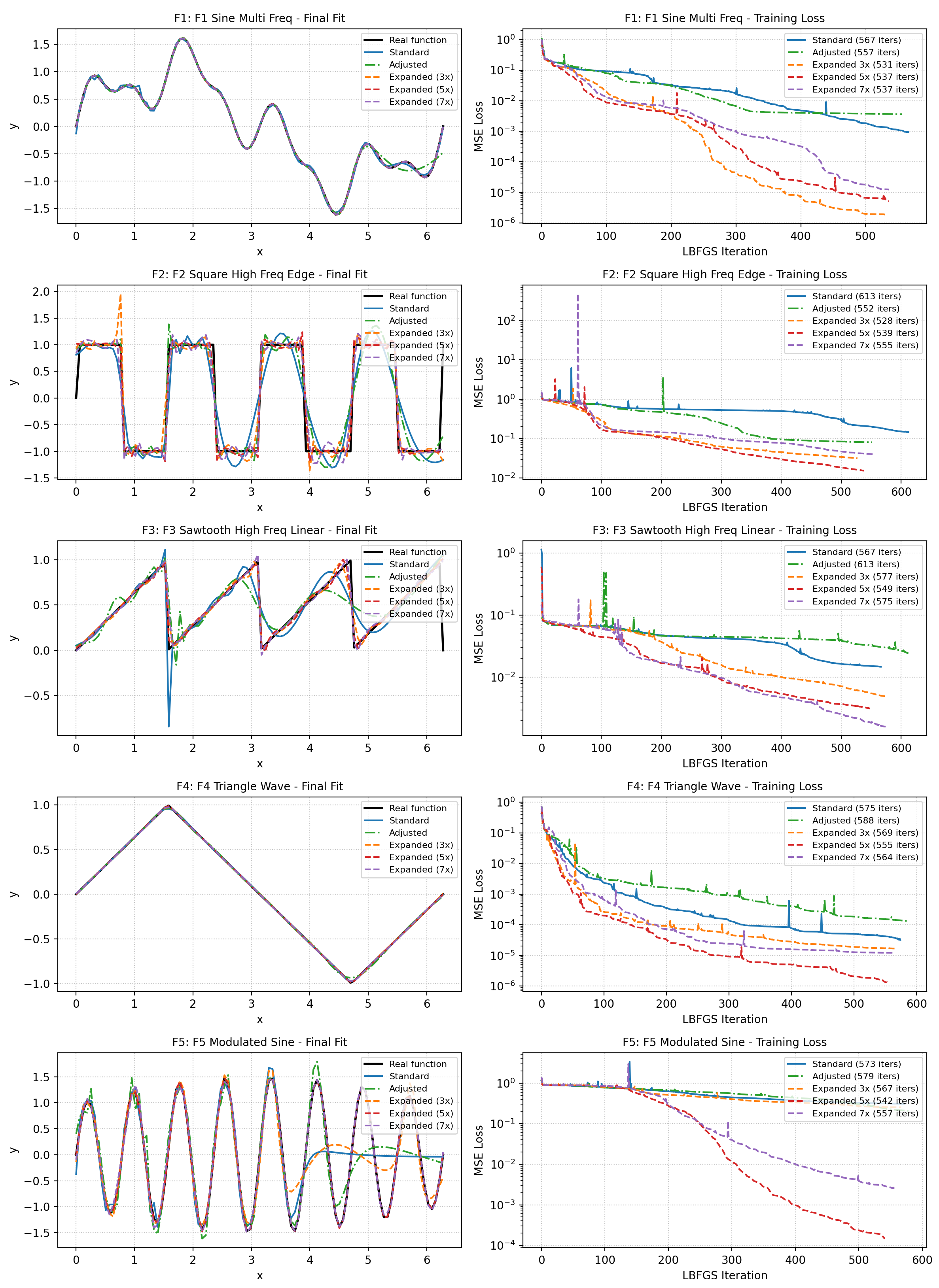

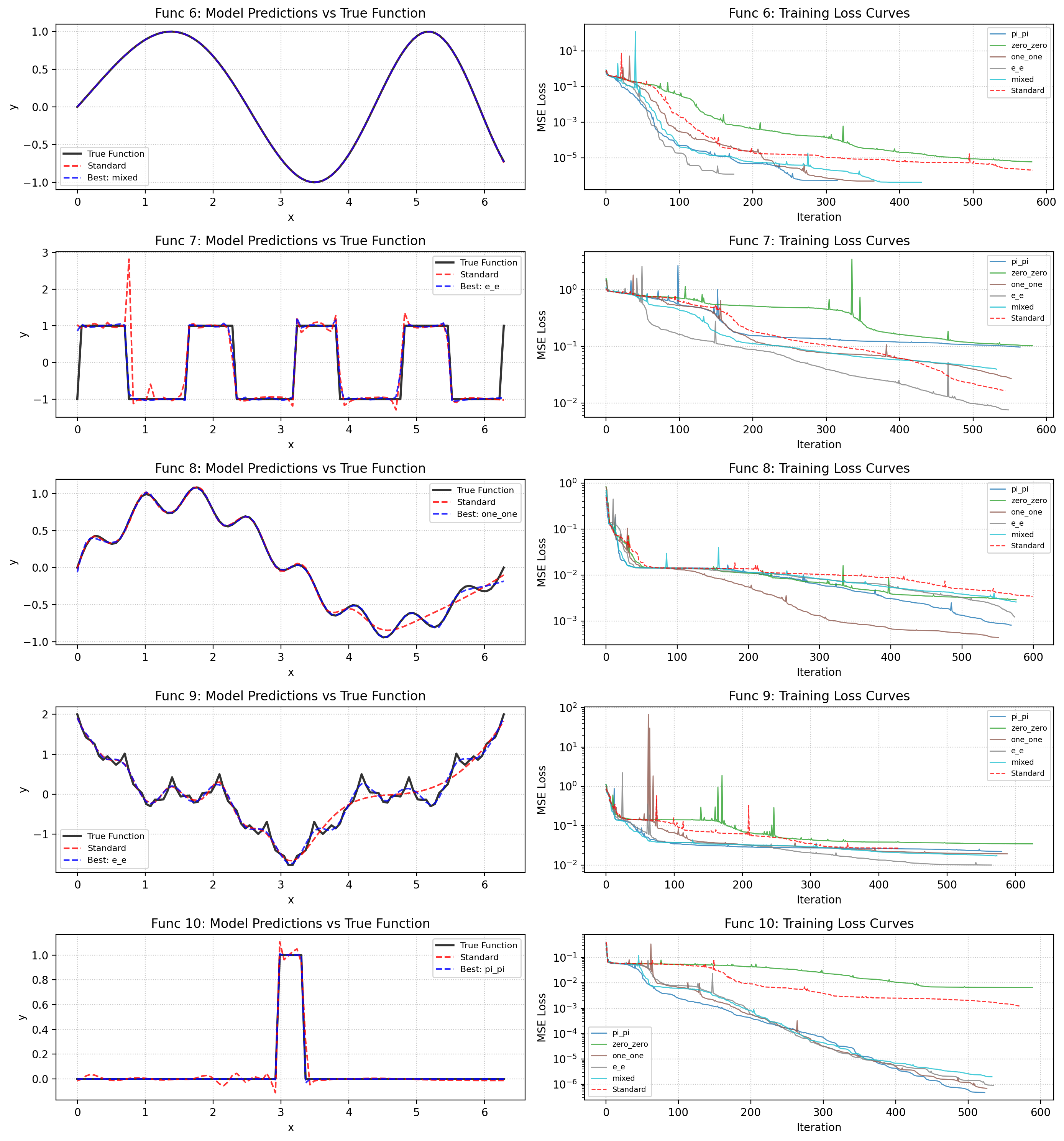

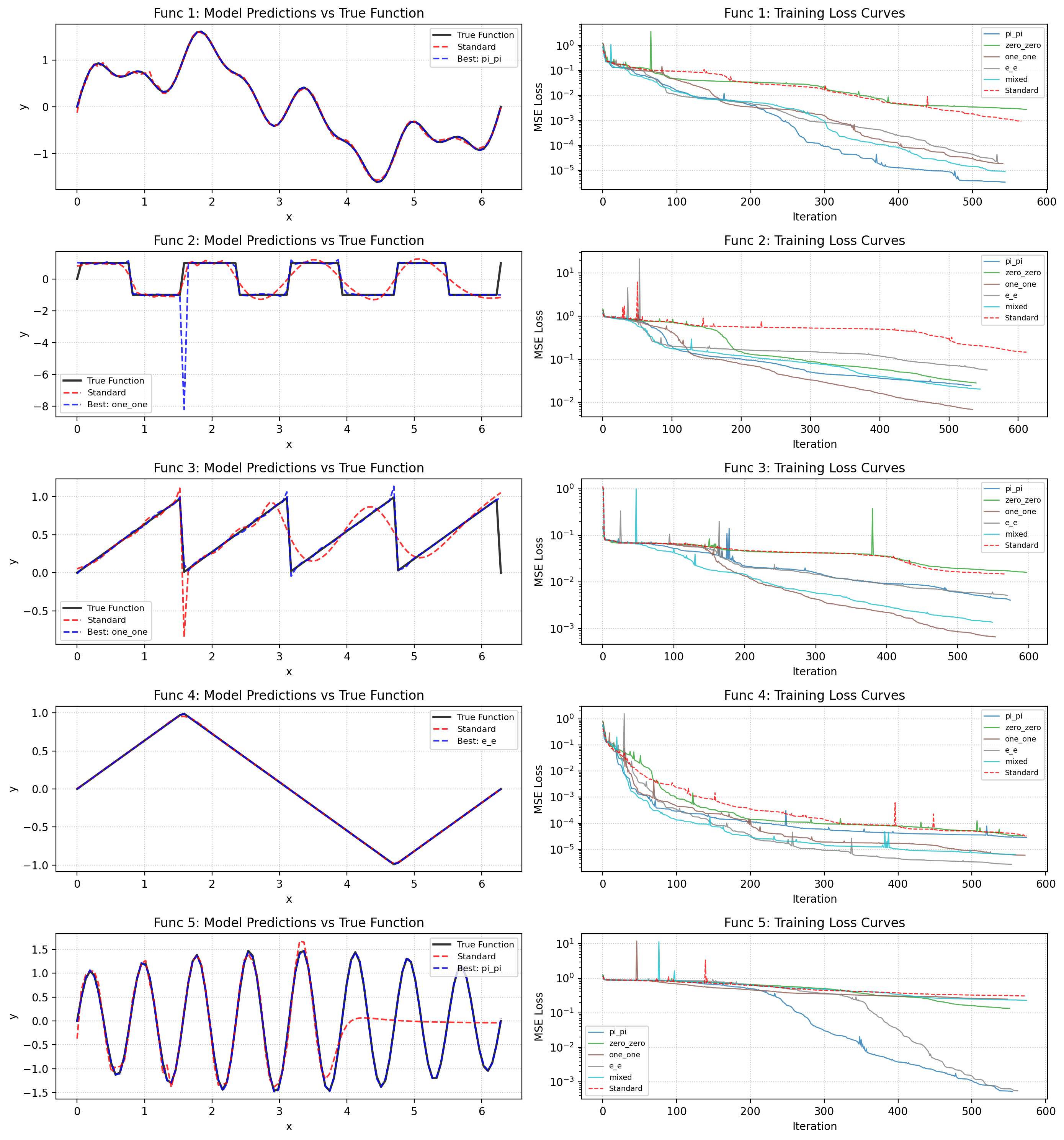

Строгая Проверка: Разнообразие Тестовых Функций

Для оценки эффективности нейронных сетей, обученных с использованием метода расширения входного пространства (Input-Space Expansion), применяется комплекс тестовых функций, включающий в себя как непрерывные, но нигде не дифференцируемые функции, такие как функция Вейерштрасса и треугольная волна, так и разрывные функции, включая прямоугольную волну и гребенчатую функцию. Использование данного набора функций позволяет всесторонне проверить способность сети к обобщению и устойчивости к различным типам входных данных, что необходимо для надежной работы в реальных приложениях.

Для оценки устойчивости и точности нейронных сетей, обученных с использованием расширения пространства ввода, в тестовый набор включены как непрерывные, но нигде не дифференцируемые функции, такие как функция Вейерштрасса и треугольная волна, так и разрывные функции, включая прямоугольную волну и гребенчатую функцию. Функция Вейерштрасса характеризуется непрерывностью и бесконечной вариацией, что представляет сложность для стандартных методов оптимизации. Треугольная волна, будучи кусочно-линейной функцией, проверяет способность сети к аппроксимации негладких сигналов. Прямоугольная волна и гребенчатая функция, содержащие резкие переходы, служат для оценки способности сети к моделированию сигналов с дискретными компонентами и высокими частотами.

Для оценки способности сети захватывать нестационарные и изменяющиеся во времени сигналы используются сложные функции, такие как осциллятор Ван дер Поля, частотная модуляция (Frequency Chirp) и модулированная синусоида. Применение этих функций в тестовом наборе позволило добиться снижения средней квадратичной ошибки (MSE) на 66.3% по сравнению с результатами, полученными на всех десяти эталонных функциях. Это демонстрирует эффективность разработанного подхода в обработке сигналов, характеристики которых меняются во времени, что критически важно для широкого спектра приложений, включая анализ временных рядов и обработку звука.

Влияние на Приближение Функций и За Его Пределами

Исследования показали, что расширение входного пространства стабильно повышает эффективность нейронных сетей при работе с широким спектром тестовых функций. Данный подход демонстрирует значительное улучшение способности сети к аппроксимации функций, что подтверждается результатами экспериментов с различными типами данных. Постоянное повышение производительности при использовании данной методики указывает на её универсальность и применимость в различных областях машинного обучения, от решения простых задач до работы со сложными спектральными функциями. Подобная стабильность позволяет предположить, что расширение входного пространства является ценным инструментом для улучшения общей производительности и надежности нейронных сетей.

Исследования показывают, что намеренное нарушение симметрии параметров в нейронных сетях является эффективной стратегией для повышения их способности к аппроксимации функций. В ходе экспериментов зафиксировано значительное улучшение точности — снижение среднеквадратичной ошибки (MSE) на 89.3% для гладких функций и на 97.2% для сложных спектральных функций. Это свидетельствует о том, что устранение избыточности, возникающей из-за симметричных параметров, позволяет сети более эффективно использовать свои ресурсы и достигать лучших результатов в задачах моделирования и предсказания.

Исследование показывает, что предлагаемый метод, основанный на расширении пространства входных данных, эффективно решает проблему спектрального смещения, свойственного многослойным персептронам (MLP). Традиционно, MLP склонны отдавать предпочтение низкочастотным компонентам, что затрудняет точное моделирование функций с высокой частотой. Однако, данный подход позволяет сети более эффективно захватывать высокочастотные составляющие, значительно улучшая точность аппроксимации. В результате, для гладких функций наблюдается снижение количества итераций обучения на 21.0%, а для сложных спектральных функций — на 31.1%, что свидетельствует о значительном повышении эффективности и скорости сходимости алгоритма.

Представленная работа демонстрирует стремление к лаконичности и эффективности в процессе аппроксимации функций. Авторы, подобно скульптору, отсекают избыточное, оставляя лишь суть — расширение входных данных для разрушения симметрии параметров. Этот подход, не увеличивая вычислительные затраты, позволяет ускорить сходимость оптимизации нейронных сетей. Как заметила Ада Лавлейс: «То, что сейчас называют искусственным интеллектом, является лишь отражением нашего собственного интеллекта». В данном исследовании, эта отражённая способность к оптимизации и упрощению становится особенно заметной, подчеркивая важность поиска элегантных решений даже в сложных задачах.

Что дальше?

Предложенный подход к расширению входных данных, безусловно, смягчает симметрии параметров. Но абстракции стареют. Вопрос в том, насколько универсален этот метод за пределами задач аппроксимации функций. Эффективность, достигнутая благодаря «дешевому» расширению, может оказаться зависимой от специфики решаемой задачи и архитектуры сети. Каждая сложность требует алиби, и необходимо тщательно исследовать случаи, когда предложенный метод не дает преимуществ.

Очевидным направлением дальнейших исследований является адаптация стратегии расширения входных данных. Постоянные значения — это простота, но, возможно, оптимальное расширение должно быть динамическим, зависящим от этапа оптимизации или характеристик данных. Использование информации о градиентах или вторых производных для формирования расширения представляется перспективным, хотя и требует дополнительных вычислений.

В конечном счете, истинная ценность предложенного метода заключается не в ускорении оптимизации LBFGS, а в демонстрации возможности «взлома» симметрий без увеличения вычислительной нагрузки. Принципы — нет. Следует рассмотреть, можно ли обобщить этот подход на другие алгоритмы оптимизации и даже на другие области машинного обучения, где симметрии мешают достижению оптимальных решений.

Оригинал статьи: https://arxiv.org/pdf/2602.17952.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Российский рынок в зоне турбулентности: рубль, ставки и новые риски (10.04.2026 01:32)

- Oppo Find X9 Ultra ОБЗОР: большой аккумулятор, скоростная зарядка, чёткое изображение

- Неважно, на что вы фотографируете!

- Motorola Moto G34 ОБЗОР: большой аккумулятор, быстрый сенсор отпечатков, лёгкий

- Canon EOS 80D

- IdeaPad Slim 3 15IRH10R ОБЗОР

- Honor X80i ОБЗОР: плавный интерфейс, большой аккумулятор, объёмный накопитель

- Proton только что запустил альтернативу Google Workspace и Microsoft 365, ориентированную на конфиденциальность.

- Realme Narzo 70 ОБЗОР: плавный интерфейс, большой аккумулятор, замедленная съёмка видео

- Как использовать режимы съёмки P, S, A, M на фотоаппарате?

2026-02-24 03:07