Автор: Денис Аветисян

Новое исследование ставит под сомнение, насколько внутренние представления нейронных сетей, обученных предсказывать активность мозга, соответствуют организации биологической зрительной системы.

Пока крипто-инвесторы ловят иксы и ликвидации, мы тут скучно изучаем отчетность и ждем дивиденды. Если тебе близка эта скука, добро пожаловать.

Купить акции "голубых фишек"

Анализ репрезентативного сходства показывает значительные различия между внутренними представлениями нейронных сетей и нейронными механизмами мозга, особенно в отношении временной динамики и принципов кодирования информации.

Несмотря на впечатляющий успех нейронных сетей-оснований в моделировании биологических зрительных систем, их внутренняя работа остается непрозрачной, ограничивая понимание принципов работы мозга. В настоящей работе, озаглавленной ‘How ‘Neural’ is a Neural Foundation Model?’, авторы исследуют внутренние представления современной нейронной сети, обученной предсказывать активность нейронов, анализируя отклики каждого «нейрона» на параметрические стимулы. Полученные результаты демонстрируют, что организация внутренних слоев модели значительно отличается от биологической, особенно в отношении сложности временных динамик и преобладании интенсивности над формой сигнала. Возможно ли приблизить архитектуру нейронных сетей-оснований к биологическим системам, внедрив рекуррентные связи на ранних этапах и ограничив сложность признаков в выходном слое?

Раскрывая Сложность: Основы Нейронной Сети

Понимание сложных нейронных вычислений требует моделей, которые отражают всю сложность биологических систем, отходя от упрощенных абстракций. Традиционно, нейронные сети строились на базе сильно упрощенных предположений о работе мозга, что ограничивало их способность воспроизводить реальное поведение. Однако, современный подход заключается в создании моделей, способных учитывать разнообразие типов нейронов, сложность их связей и динамику передачи сигналов. Такие модели, основанные на больших объемах данных и реалистичных принципах функционирования мозга, позволяют исследователям не просто имитировать нейронные процессы, но и получать новые знания о том, как мозг обрабатывает информацию и принимает решения. Этот переход к более реалистичным моделям открывает новые возможности для изучения когнитивных функций, разработки новых методов лечения неврологических заболеваний и создания искусственного интеллекта, приближенного к человеческому.

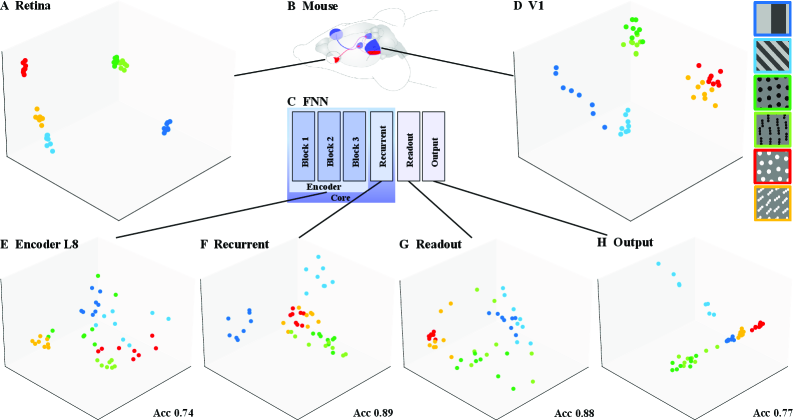

Основа нейронной сети (FNN) представляет собой мощный, основанный на данных подход к моделированию зрительной системы мыши. Эта сеть обучалась на обширном наборе данных MICrONS, содержащем детальные сведения о структуре и активности нейронов коры головного мозга. В отличие от традиционных моделей, которые часто полагаются на упрощенные предположения, FNN использует реальные данные для создания более точного и биологически правдоподобного представления о том, как мозг обрабатывает визуальную информацию. Такой подход позволяет исследователям изучать сложные нейронные вычисления и лучше понимать принципы работы зрительной системы, открывая новые возможности для разработки алгоритмов машинного зрения и лечения неврологических расстройств.

Пространство Кодирования: Раскрытие Нейронных Представлений

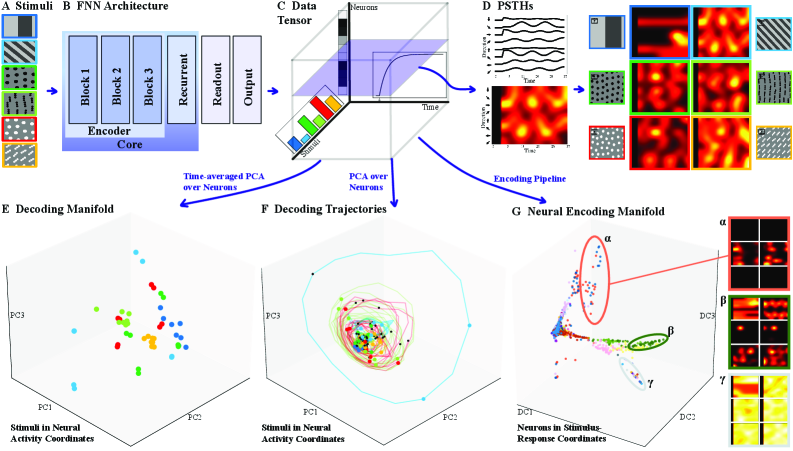

Нейронная сеть (FNN) формирует многомерное пространство кодирования (Encoding Manifold), которое отражает совместную активность популяций нейронов. Это пространство представляет собой высокоразмерное отображение внутренних состояний сети, вызванных входными стимулами. Анализ этого многообразия является ключевым для понимания процессов обработки информации, поскольку позволяет выявить, как различные входные данные преобразуются и кодируются в паттерны нейронной активности. По сути, структура и свойства этого многообразия определяют, как сеть представляет и обрабатывает информацию, и позволяют исследователям реконструировать входные данные по паттернам активности или предсказывать будущие состояния сети.

Для анализа многомерного пространства кодирования, генерируемого нейронной сетью, применяются методы понижения размерности, такие как Неотрицательная Тензорная Факторизация (НТФ) и Диффузионные Карты. НТФ позволяет разложить тензор, представляющий активность нейронных популяций, на сумму ранговых тензоров, выявляя скрытые факторы, влияющие на представление данных. Диффузионные Карты, в свою очередь, строят представление данных, основанное на графе связности между точками в пространстве кодирования, что позволяет выявить нелинейные структуры и отношения, которые могут быть не видны при использовании линейных методов понижения размерности. Оба метода направлены на упрощение анализа и визуализацию данных, сохраняя при этом наиболее важную информацию о структуре и взаимосвязях в пространстве кодирования.

Структура сети, состоящая из модулей Перспективы, Модуляции, Кодирования, Рекуррентности и Считывания, определяет последовательность преобразований входных стимулов и их последующее представление. Модуль Перспективы формирует начальное представление входных данных. Модуль Модуляции регулирует активность сети в зависимости от контекста. Модуль Кодирования преобразует информацию в компактное, распределенное представление. Рекуррентный модуль обрабатывает временные зависимости во входных данных, а модуль Считывания декодирует внутреннее представление для получения выходных сигналов. Взаимодействие этих модулей формирует способ, которым сеть кодирует и представляет информацию, определяя ее вычислительные возможности.

Динамические Траектории и Коррекция Артефактов: Оценка Нейронных Путей

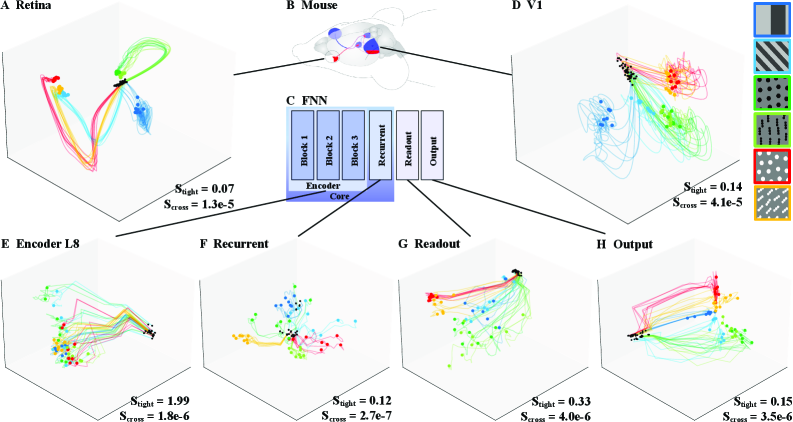

Анализ нейронных траекторий в пространстве кодирования (encoding manifold) позволяет исследовать динамику обработки информации в нейронных сетях. Однако, архитектурные особенности искусственных нейронных сетей могут приводить к появлению артефактов интенсивности, искажающих наблюдаемые паттерны траекторий. Эти артефакты возникают из-за особенностей реализации функций активации и взаимодействия между нейронами, что приводит к нефизиологичным колебаниям в активности и, как следствие, к деформации визуализируемых траекторий. Выявление и учет подобных артефактов критически важны для корректной интерпретации результатов анализа и обеспечения адекватного сравнения с биологическими данными.

Анализ трубной окрестности (Tubular Neighborhood Analysis) представляет собой метод оценки геометрии траекторий нейронной активности, позволяющий выявлять и смягчать артефакты, возникающие в процессе анализа. Данный подход предполагает построение трубчатой окрестности вокруг каждой траектории и последующую оценку ее геометрических характеристик, таких как степень скрученности и количество пересечений. Высокая степень скрученности указывает на более организованные и упорядоченные траектории, в то время как большое количество пересечений свидетельствует о наличии шума или артефактов, искажающих истинные паттерны нейронной активности. Использование анализа трубной окрестности позволяет отделить полезный сигнал от шума и получить более точное представление о лежащих в основе нейронных вычислениях.

Анализ траекторий в рамках нейронной сети прямого распространения (FNN) показал, что её структура характеризуется более низкой трубчатостью (Tightness) и более высокой трубчатостью (Crossings) по сравнению с биологическими данными. Низкая трубчатость указывает на менее организованные пучки траекторий, что свидетельствует о слабой структуре представления информации. Высокая трубчатость (Crossings) отражает большее количество поперечных пересечений траекторий, что говорит о меньшей согласованности и потенциальной путанице в процессе обработки информации внутри сети. Данные показатели позволяют сделать вывод о структурных различиях между FNN и биологическими нейронными сетями в организации динамических паттернов.

Уточненное представление, полученное в результате анализа и митигации артефактов траекторий, обеспечивает более точное отражение лежащих в основе нейронных вычислений. Это достигается за счет снижения искажений, вызванных архитектурными особенностями нейронной сети, что позволяет более адекватно оценивать динамику обработки информации. В результате, наблюдаемые траектории лучше соответствуют биологическим данным и предоставляют более достоверную картину процессов, происходящих в нейронных сетях при выполнении различных задач. Повышенная точность представления способствует более глубокому пониманию принципов работы искусственного интеллекта и позволяет проводить более обоснованные исследования в области нейронаук.

Соединяя Разрозненное: Проверка и Биологическая Релевантность

Для оценки прогностической способности разработанной искусственной нейронной сети (ИНС) использовался метод линейной регрессии. Этот подход позволил установить связь между внутренними состояниями сети и фактической активностью биологических нейронов. В ходе исследования, внутренние представления ИНС служили входными данными для модели линейной регрессии, которая предсказывала паттерны активности, наблюдаемые в реальных нейронных сетях. Полученные результаты позволили количественно оценить, насколько хорошо ИНС улавливает и воспроизводит сложные механизмы обработки информации, характерные для биологических систем, и выявить потенциальные области для дальнейшей оптимизации и совершенствования модели.

Для оценки сходства между искусственной нейронной сетью (FNN) и биологическими нейронными сетями применялся метод анализа сходства представлений (Representational Similarity Analysis, RSA). Данный подход позволяет сопоставить, насколько схожим образом FNN и биологические сети кодируют информацию о стимулах. В рамках RSA вычисляются матрицы сходства представлений для каждой сети, отражающие, насколько близки друг к другу внутренние состояния сети при предъявлении различных стимулов. Сравнение этих матриц позволяет выявить, насколько представления, формируемые FNN, соответствуют тем, что наблюдаются в биологических нейронных сетях, и, следовательно, насколько адекватно модель отражает принципы кодирования информации в мозге. Высокая степень соответствия между матрицами указывает на схожие механизмы представления информации, в то время как расхождения могут свидетельствовать о принципиальных различиях в организации и функционировании искусственной и биологической систем.

Исследование выявило существенные расхождения между структурами декодирования искусственной нейронной сети (FNN) и биологических нейронных сетей, что указывает на различия в способах представления и разделения стимулов. Анализ показал, что FNN и мозг, хотя и способны обрабатывать информацию, организуют представления стимулов в различных пространствах, что проявляется в отличных структурах декодирования. Данное несоответствие подчеркивает, что, несмотря на способность FNN предсказывать активность биологических нейронов, ее внутренние механизмы кодирования информации отличаются от тех, что используются в мозге, указывая на необходимость дальнейших исследований для создания более реалистичных и биологически правдоподобных моделей.

Канонический корреляционный анализ позволил выявить статистически значимые корреляции между активностью искусственной нейронной сети и сигналами, регистрируемыми в биологических нейронных сетях. Этот метод, позволяющий установить связь между множествами переменных, продемонстрировал, что внутренние состояния разработанной сети отражают определенные аспекты обработки информации, наблюдаемые в мозге. В частности, удалось обнаружить соответствие между паттернами активности в искусственной сети и изменениями в нейронных сигналах, возникающими в ответ на стимуляцию. Полученные результаты укрепляют уверенность в том, что модель способна улавливать и воспроизводить некоторые ключевые принципы работы биологических нейронных сетей, открывая возможности для дальнейшего изучения механизмов обработки информации в мозге.

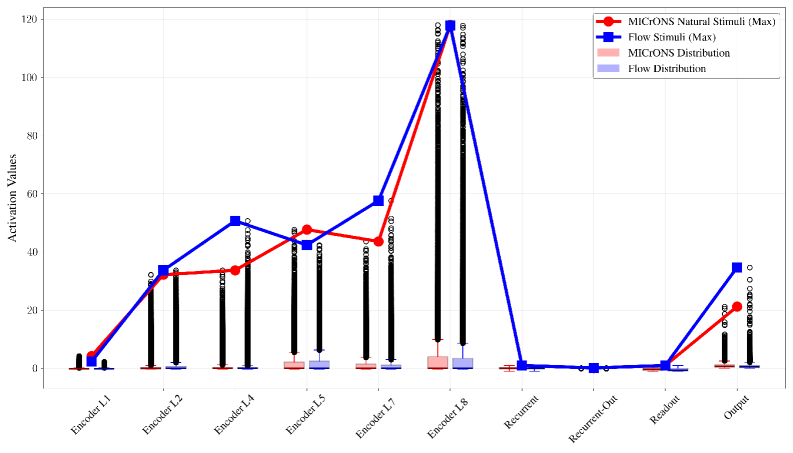

Исследование внутренних представлений нейронных сетей, представленное в данной работе, подчеркивает разницу между искусственным и биологическим интеллектом. Модель, обученная предсказывать нейронную активность, демонстрирует приемлемую производительность, однако её внутренняя организация значительно отличается от визуальной системы человека. Как заметил Блез Паскаль: «Человек — это тростник, самый слабый в природе, но это тростник, который мыслит». Аналогично, данная нейронная сеть, хоть и способна к прогнозированию, демонстрирует упрощенный подход к обработке информации, в частности, отсутствие сложных временных динамик, характерных для биологических систем. Анализ репрезентативного сходства и обучение на многообразиях выявляет, что модель в большей степени полагается на интенсивность, чем на сложные паттерны, что указывает на принципиальные различия в способах кодирования информации.

Что дальше?

Исследование внутренних представлений «нейронных» фундаментальных моделей обнажает парадоксальную ситуацию. Достигая формального успеха в предсказании нейронной активности, эти модели демонстрируют принципиально иную организацию, нежели биологические визуальные системы. Отсутствие сложных временных динамик и преобладание интенсивности в качестве ключевого признака — это не просто технические ограничения, а указание на фундаментальное различие в принципах обработки информации. Понимание этих различий требует перехода от простого сопоставления производительности к детальному анализу структуры и эволюции представлений.

В дальнейшем, необходимо сосредоточиться на разработке методов, позволяющих не только оценивать, но и направленно формировать внутренние представления моделей, приближая их к биологической правдоподобности. Ключевым представляется исследование роли разреженности, иерархической организации и динамических связей в формировании эффективных и гибких представлений. Ирония заключается в том, что, стремясь воспроизвести мозг, искусственный интеллект может потребовать от нас более глубокого понимания самого мозга.

Будущие исследования должны выйти за рамки чисто вычислительных методов и активно использовать принципы нейробиологии и теории информации. Необходимо разработать метрики, способные оценивать не только точность предсказания, но и сложность, обобщающую способность и устойчивость представлений. В конечном счете, задача состоит не в создании «искусственного мозга», а в понимании универсальных принципов обработки информации, лежащих в основе интеллекта, будь он биологическим или искусственным.

Оригинал статьи: https://arxiv.org/pdf/2601.21508.pdf

Связаться с автором: https://www.linkedin.com/in/avetisyan/

Смотрите также:

- Рынок в ожидании ставки: что ждет рубль, нефть и акции? (20.03.2026 01:32)

- Что такое Bazzite и лучше ли она, чем Windows для PC-гейминга? Я установил этот набирающий популярность дистрибутив Linux, чтобы проверить это самостоятельно.

- Неважно, на что вы фотографируете!

- vivo S50 Pro mini ОБЗОР: объёмный накопитель, портретная/зум камера, большой аккумулятор

- Искусственные мозговые сигналы: новый горизонт интерфейсов «мозг-компьютер»

- Российский рынок: между ростом потребления газа, неопределенностью ФРС и лидерством «РусГидро» (24.12.2025 02:32)

- Cubot Note 60 ОБЗОР: плавный интерфейс, большой аккумулятор

- Tecno Camon 50 Pro ОБЗОР: портретная/зум камера, объёмный накопитель, большой аккумулятор

- Космос в деталях: Навигация по астрономическим данным на иммерсивных дисплеях

- vivo Y05 ОБЗОР: удобный сенсор отпечатков, плавный интерфейс, яркий экран

2026-01-30 17:15